📄 BEST-STD 2.0: Balanced and Efficient Speech Tokenizer for Spoken Term Detection

#音频检索 #自监督学习 #对比学习 #最优传输 #语音分词

✅ 7.5/10 | 前25% | #音频检索 | #自监督学习 | #对比学习 #最优传输

学术质量 6.0/7 | 选题价值 1.0/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Anup Singh(IDLab, Department of Electronics and Information Systems, Ghent University, Belgium)

- 通讯作者:Vipul Arora(ESAT-PSI, KU Leuven, Belgium;标注有⋆表示equal advising)

- 作者列表:Anup Singh(IDLab, Department of Electronics and Information Systems, Ghent University, Belgium)、Vipul Arora(ESAT-PSI, KU Leuven, Belgium)、Kris Demuynck(IDLab, Department of Electronics and Information Systems, Ghent University, Belgium)

💡 毒舌点评

亮点在于将最优传输(OT)优雅地用于解决语音分词码本坍缩这一老大难问题,使得大码本训练稳定且高效,且在抗噪抗混响的鲁棒性上做到了超越同类基线(包括大模型WavLM的分词)的扎实水平。短板是研究的问题域(查询式语音术语检索)略显小众,且其核心的“稳健性”提升高度依赖于特定的任务和评价指标(Jaccard相似度、MTWV),对于通用语音理解或生成任务的直接启示有限。

🔗 开源详情

- 代码:提供代码仓库链接:https://github.com/anupsingh15/BEST-STD2.0

- 模型权重:未提及是否公开预训练模型权重。

- 数据集:使用公开数据集LibriSpeech、TIMIT、MUSAN等进行训练和评估,但未提及是否开源特定的增强数据集或查询集。

- Demo:未提供在线演示。

- 复现材料:论文中提供了详细的实现细节(超参数、训练步数、优化器、输入特征维度等),有助于复现。

- 依赖的开源项目:论文中提到了SpeechBrain工具包(用于WavLM的K-Means分词),以及IVF-PQ索引库。此外,模型基于Mamba架构。

- 论文中未提及更广泛的开源计划(如提供处理好的中间特征、评估脚本等)。

📌 核心摘要

- 解决的问题:针对查询式语音术语检索(QbE-STD)任务,现有离散分词方法在嘈杂和混响环境中鲁棒性差,且存在码本坍缩(即分词码本利用率不均衡)导致的效率低下问题。

- 方法核心:提出BEST-STD 2.0框架。其一,采用双向Mamba编码器,并通过引入噪声/混响增强的对比学习和鲁棒一致性损失,训练出抗噪且说话人无关的帧级连续表示。其二,在向量量化(VQ)阶段,引入基于最优传输(OT)的正则化,将码本学习重构为平衡聚类问题,强制码本均匀使用,防止坍缩。最终采用TF-IDF索引和渐进式检索策略加速搜索。

- 创新之处:与之前工作(如BEST-STD 1.0)相比,新在:a) 系统性地设计了针对噪声和混响的自监督训练策略;b) 首次将最优传输理论应用于语音分词的码本平衡,解决代码崩溃;c) 专门引入针对离散分词的鲁棒性损失。

- 主要实验结果:在LibriSpeech和TIMIT数据集上的评估显示,该方法在各种噪声(-5dB到20dB SNR)和混响条件下,分词的Jaccard相似度和检索MTWV均显著优于基线(包括HuBERT、WavLM、SpeechTokenizer及上一代BEST-STD)。例如,在噪声+混响(t60=0.7s) 的极端条件下,LibriSpeech OOV任务的MTWV在5dB SNR时,BEST-STD 2.0达到0.56,而BEST-STD 1.0仅为0.27,WavLM为0.14。其分词码本熵在码本大小1024-4096下均保持在0.96以上,而KMeans基线低于0.76。

- 实际意义:提供了一种更鲁棒、高效的语音分词方案,使原始语音能够像文本一样被快速索引和检索,对于构建大规模语音数据库的检索系统具有实用价值。

- 主要局限性:方法主要针对帧级分词和检索任务设计,其生成的离散标记对语音合成、对话等需要更高级语义或韵律信息的任务是否同样有效,未进行验证。训练和评估集中于英语数据集,跨语言通用性未明。

🏗️ 模型架构

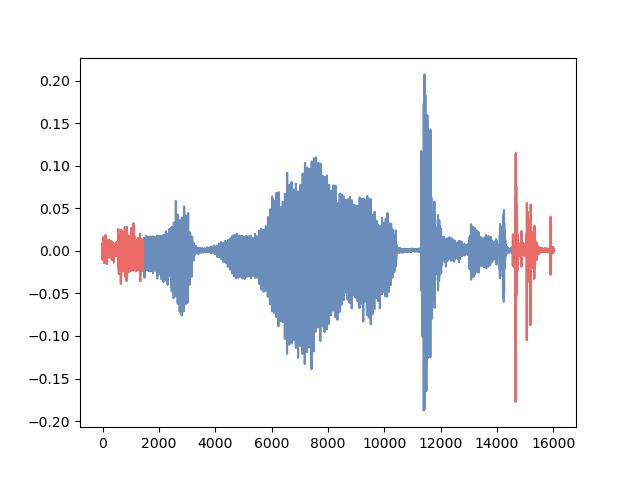

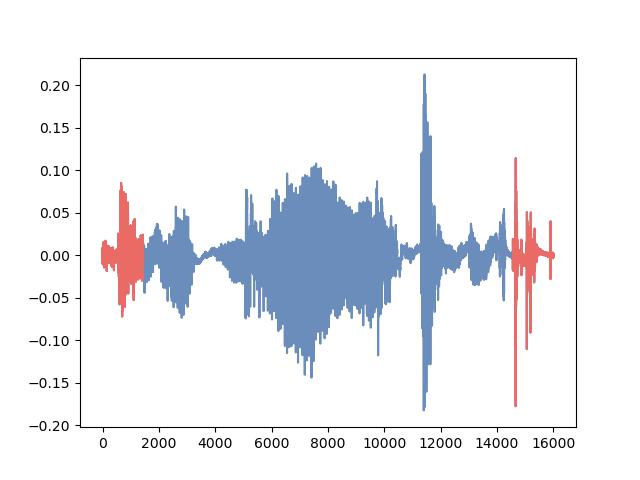

整体架构(见图1)包含编码、自监督训练和检索三个核心部分。

- 编码器:采用8层双向Mamba(BiMamba)块。输入为音频的MFCC特征序列(16维+一阶、二阶导数,共48维),BiMamba层对序列进行上下文建模,输出帧级嵌入序列Z。随后通过一个投影层映射到128维空间,并进行L2归一化,得到单位范数的连续表示

z_t。 - 自监督学习框架(训练阶段):

- 输入对构建:对于同一口语词

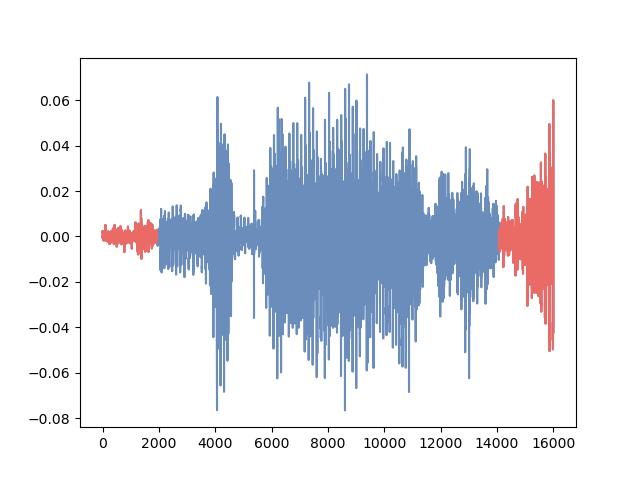

w,取两个不同说话人的语音u和ũ。对ũ随机添加噪声和混响,得到失真版本ũ_n。两段语音添加上下文填充(pad)至固定长度,确保可直接输入编码器。 - 对齐与配对:对填充后的MFCC特征

X和~X使用动态时间规整(DTW) 进行对齐,排除填充帧,得到帧级对应关系A。这构成了自监督信号:对齐帧(t, ˜t)在嵌入空间Z(来自u)和~Z_n(来自ũ_n)中构成锚点-正样本对(z_t, ˜z_{˜t})。 - 向量量化(VQ):将连续表示

Z和~Z_n通过可学习的码本C(包含K个d=128维码字)进行量化,通过余弦相似度匹配最近码字,得到离散序列ˆZ和ˆZ_n。 - 核心损失函数:

- 对比损失 (

L_contrast):标准对比学习损失,增强锚点z_t与正样本˜z_{˜t}的相似度,同时拉远与同批次其他负样本z_k的距离。温度参数τ=0.1。 - 鲁棒一致性损失 (

L_robust):约束锚点z_t和失真正样本˜z_{˜t}在码本上产生相同的概率分布(通过交叉熵L(z_t, ˜z_{˜t})和反向项实现)。这是保证分词抗噪的关键。 - 承诺损失 (

L_commit):确保连续嵌入z_t靠近其被分配的离散码字ˆz_t。 总损失:L = L_contrast + λ1L_robust + λ2*L_commit,权重λ1=1, λ2=10。

- 对比损失 (

- 输入对构建:对于同一口语词

- 最优传输(OT)正则化:这是解决码本坍缩的核心。论文将码本平衡问题建模为一个OT问题:目标是最大化所有嵌入

z与码字c_k的分配收益(-s_k(z)即负余弦相似度为成本),并约束每个码字c_k在整个批次中的期望分配概率E_z[p(z|c_k)]恒为1/K。这强制码本被均匀使用。OT解由Sinkhorn-Knopp算法高效计算,得到的概率p(z_t|c_k)被代入L_robust中。 - 检索流程:

- 索引:将音频库分割为固定长度(1s)重叠片段。对每个片段提取连续表示Z,量化得到离散标记序列。构建TF-IDF表示,并使用IVF-PQ进行快速索引。

- 渐进检索:给定查询,生成其TF-IDF表示。第一阶段从索引中检索候选集

P1;第二阶段用Jaccard相似度过滤得到P2;第三阶段用基于编辑距离的时序过滤得到最终结果P3。

💡 核心创新点

- 噪声与混响增强的对比学习框架:通过在训练中引入随机的噪声和混响失真,并利用DTW对齐构建失真前后同一语音片段的嵌入对,强制模型学习不变特征。此前方法(如BEST-STD 1.0)缺乏此类系统性的抗噪训练,导致分词在嘈杂环境下性能骤降。

- 基于最优传输(OT)的平衡码本学习:将分词码本的训练转化为一个最优传输问题,通过Sinkhorn-Knopp算法求解,显式约束每个码字被均匀使用。这直接解决了VQ中普遍存在的码本坍缩问题(即少数码字占据绝大多数分配),使得即使码本很大(4096),利用率熵也能接近1.0,极大提升了分词的区分度和效率。

- 专门针对离散分词的鲁棒一致性损失 (

L_robust):不同于仅在连续空间做对比,该损失直接在离散概率分布层面约束,要求失真前后的语音片段在码本上产生一致的分布,是实现“抗噪分词”的直接优化目标。 - BiMamba与Transformer的实验对比:论文在相同框架下比较了BiMamba和Transformer编码器,发现在抗噪任务上BiMamba优于Transformer,归因于其线性时间建模更有效。这为选择语音分词的编码器架构提供了实证参考。

🔬 细节详述

- 训练数据:在LibriSpeech

train-clean-360子集上训练,在test-clean上验证。语音库和查询使用train-clean-100子集构建,确保评估使用未见过的说话人。数据增强使用MUSAN语料库的噪声和房间冲激响应(RIR)。 - 损失函数:见01节详述。

L_contrast(对比损失),L_robust(鲁棒一致性损失),L_commit(承诺损失),三者加权求和,λ1=1, λ2=10。 - 训练策略:

- 优化器:Adam

- 学习率:

5×10^{-4} - 批大小(Batch Size):96

- 训练步数:740k steps

- 学习率调度:论文未提及。

- 关键超参数:

- 音频分段长度(l):1秒

- MFCC特征:16维MFCC + 一阶、二阶导数 = 48维,25ms窗口,10ms帧移。

- 编码器:8层双向Mamba,输出投影至d=128维,总参数量8.1M。

- 码本大小(K):实验对比了1024, 2048, 4096。

- 温度参数(τ, τ’):均为0.1。

- 训练硬件:未说明GPU/TPU型号和数量,也未说明总训练时长。

- 推理细节:检索使用渐进式策略,分三步进行过滤(IVF-PQ索引 → Jaccard相似度 → 编辑距离)。

- 正则化/稳定训练技巧:OT正则化本身就是最重要的稳定训练技巧,防止码本坍缩。此外,对嵌入和码字进行了L2归一化。

📊 实验结果

- 分词一致性分析(表1):在5k个跨说话人语音词对上计算Jaccard相似度。在各种失真条件下,BEST-STD 2.0均表现最优。在Clean条件下,其相似度为0.86,远高于BEST-STD的0.72。在Noise+Reverb (t60=0.7s) 条件下,即使在-5dB SNR,其相似度仍达0.61,而BEST-STD仅为0.19,WavLM为0.06。这直接证明了方法的鲁棒性。

表1. 不同失真条件下,语音分词表示对的平均Jaccard相似度(↑)

| 模型 | 分词类型 | Clean | Noise -5dB | Noise 5dB | Noise+Reverb -5dB | Noise+Reverb 5dB |

|---|---|---|---|---|---|---|

| HuBERT-Large | ASR Posteriors (32) | 0.73 | 0.46 | 0.67 | 0.24 | 0.49 |

| WavLM-Large | ASR Posteriors (32) | 0.72 | 0.62 | 0.70 | 0.52 | 0.65 |

| SpeechTokenizer | 语义分词 (1024) | 0.45 | 0.09 | 0.15 | 0.03 | 0.05 |

| WavLM-Large | K-Means分词 (1000) | 0.40 | 0.18 | 0.21 | 0.16 | 0.18 |

| BEST-STD | K-Means分词 (1024) | 0.72 | 0.21 | 0.42 | 0.19 | 0.38 |

| Ours - Transformer | 学习分词 (1024) | 0.78 | 0.67 | 0.75 | 0.57 | 0.68 |

| BEST-STD 2.0 | 学习分词 (1024) | 0.86 | 0.72 | 0.81 | 0.61 | 0.74 |

- 检索性能(MTWV,表2):在LibriSpeech和TIMIT上,无论仅有噪声还是噪声+混响,BEST-STD 2.0在IV(词汇内) 和OOV(词汇外) 查询上的MTWV均达到最高。例如,在TIMIT Noise+Reverb OOV任务,5dB SNR下,BEST-STD 2.0达到0.60,而最佳基线WavLM仅为0.23。在LibriSpeech上,它在20dB SNR的OOV任务达到0.68。

表2. 不同失真条件下,LibriSpeech(左)和TIMIT(右)的口语术语检测MTWV(↑)

| 模型 | LibriSpeech IV (-5dB/5dB/20dB) | LibriSpeech OOV (-5dB/5dB/20dB) | TIMIT IV (-5dB/5dB/20dB) | TIMIT OOV (-5dB/5dB/20dB) |

|---|---|---|---|---|

| HuBERT-Large | 0.13 / 0.30 / 0.47 | 0.16 / 0.34 / 0.43 | 0.14 / 0.31 / 0.51 | 0.16 / 0.37 / 0.46 |

| WavLM-Large | 0.31 / 0.43 / 0.58 | 0.29 / 0.41 / 0.45 | 0.33 / 0.44 / 0.61 | 0.33 / 0.46 / 0.50 |

| SpeechTokenizer | 0.14 / 0.39 / 0.53 | 0.13 / 0.30 / 0.49 | 0.15 / 0.42 / 0.57 | 0.15 / 0.34 / 0.52 |

| WavLM-Large (K-Means) | 0.17 / 0.40 / 0.55 | 0.17 / 0.35 / 0.49 | 0.19 / 0.44 / 0.61 | 0.19 / 0.35 / 0.51 |

| BEST-STD | 0.27 / 0.43 / 0.62 | 0.22 / 0.37 / 0.54 | 0.29 / 0.47 / 0.66 | 0.25 / 0.40 / 0.56 |

| Ours-Transformer | 0.51 / 0.61 / 0.67 | 0.50 / 0.60 / 0.65 | 0.55 / 0.66 / 0.75 | 0.52 / 0.64 / 0.69 |

| BEST-STD 2.0 | 0.58 / 0.72 / 0.77 | 0.51 / 0.65 / 0.68 | 0.60 / 0.78 / 0.82 | 0.53 / 0.67 / 0.71 |

表2续. 不同失真(噪声+混响)条件下,LibriSpeech(左)和TIMIT(右)的口语术语检测MTWV(↑)

| 模型 | LibriSpeech IV (-5dB/5dB/20dB) | LibriSpeech OOV (-5dB/5dB/20dB) | TIMIT IV (-5dB/5dB/20dB) | TIMIT OOV (-5dB/5dB/20dB) |

|---|---|---|---|---|

| HuBERT-Large | 0.02 / 0.09 / 0.24 | 0.02 / 0.12 / 0.29 | 0.03 / 0.12 / 0.27 | 0.08 / 0.24 / 0.30 |

| WavLM-Large | 0.11 / 0.24 / 0.36 | 0.15 / 0.29 / 0.37 | 0.12 / 0.23 / 0.39 | 0.18 / 0.31 / 0.41 |

| SpeechTokenizer | 0.03 / 0.11 / 0.20 | 0.02 / 0.06 / 0.16 | 0.05 / 0.18 / 0.23 | 0.07 / 0.14 / 0.23 |

| WavLM-Large (K-Means) | 0.06 / 0.19 / 0.39 | 0.04 / 0.14 / 0.31 | 0.08 / 0.23 / 0.36 | 0.10 / 0.23 / 0.30 |

| BEST-STD | 0.18 / 0.34 / 0.51 | 0.13 / 0.27 / 0.43 | 0.20 / 0.36 / 0.54 | 0.17 / 0.33 / 0.48 |

| Ours-Transformer | 0.41 / 0.55 / 0.60 | 0.40 / 0.52 / 0.57 | 0.43 / 0.56 / 0.64 | 0.41 / 0.55 / 0.59 |

| BEST-STD 2.0 | 0.45 / 0.61 / 0.68 | 0.40 / 0.56 / 0.62 | 0.47 / 0.63 / 0.71 | 0.43 / 0.60 / 0.66 |

- 码本分析(表3):通过归一化熵衡量码本使用平衡性。BEST-STD 2.0在1024-4096码本大小下熵均接近1(0.98-0.96),表明码本使用极其均匀。而KL散度正则化(类似wav2vec 2.0)和KMeans方法熵随码本增大而显著下降,发生坍缩。

表3. 不同码本大小下的码本归一化熵

| 模型 | 分词类型 | 1024 | 2048 | 4096 |

|---|---|---|---|---|

| KL Divergence [27] | 可学习码本 | 0.63 | 0.50 | 0.38 |

| BEST-STD | K-Means | 0.76 | 0.65 | 0.43 |

| BEST-STD 2.0 | 可学习码本 | 0.98 | 0.97 | 0.96 |

检索延迟:在内存搜索(Intel Xeon Platinum 8268 CPU)中,对于一个查询,检索Top-10结果平均耗时约1.2秒,相比使用倒排索引的BEST-STD(约3.4秒)实现了约3倍的速度提升。

编码器消融:表1和表2显示,在相同框架下,BiMamba编码器(BEST-STD 2.0)在所有指标上均优于Transformer编码器(Ours-Transformer),证明了BiMamba在抗噪时序建模上的优势。

⚖️ 评分理由

- 学术质量:6.0/7:论文工作扎实,针对明确的工程问题(STD鲁棒性、码本坍缩)提出了技术上合理且有效的解决方案。创新在于巧妙组合了OT、对比学习和抗噪训练,并在该特定任务上实现了SOTA。实验全面,有消融,数据支持充分。但核心编码器非原创,整体创新幅度属于“优秀改进”而非“范式突破”。

- 选题价值:1.0/2:研究方向(语音术语检索)相对垂直,尽管在工业语音搜索中有应用,但学术关注度不如语音生成、理解等主流任务。论文的贡献主要推动该子领域的技术进步。

- 开源与复现加成:0.5/1:提供了核心代码和详尽的训练配置,具备较高的可复现性。但未公开模型权重和部分数据资源,扣分。