📄 BACHI: Boundary-Aware Symbolic Chord Recognition Through Masked Iterative Decoding on POP and Classical Music

#音乐信息检索 #符号音乐 #迭代解码 #Transformer #数据集

✅ 7.5/10 | 前25% | #音乐信息检索 | #迭代解码 | #符号音乐 #Transformer

学术质量 7.0/7 | 选题价值 7.5/2 | 复现加成 8.0 | 置信度 高

👥 作者与机构

- 第一作者:Mingyang Yao(加州大学圣地亚哥分校)

- 通讯作者:未说明

- 作者列表:Mingyang Yao(加州大学圣地亚哥分校)、Ke Chen(加州大学圣地亚哥分校)、Shlomo Dubnov(加州大学圣地亚哥分校)、Taylor Berg-Kirkpatrick(加州大学圣地亚哥分校)

💡 毒舌点评

亮点:模型设计精巧地融合了“边界检测”与“模仿人类耳练的置信度排序解码”两个直觉,在提升性能的同时也为模型决策提供了可解释性(如古典与流行音乐预测顺序的差异)。短板:研究高度聚焦于符号音乐的钢琴编曲场景,对更复杂的乐队总谱或电子音乐等格式的适用性未做探讨,限制了其普适性。此外,在流行音乐上相比SOTA提升微乎其微,创新带来的边际效益在该风格上不明显。

🔗 开源详情

- 代码:论文明确表示已发布代码,并提供了演示网站链接 (

https://andyweasley2004.github.io/BACHI/)。论文中未直接给出代码仓库的URL,但可通过演示网站访问。 - 模型权重:论文中提到“我们发布了我们的代码、训练模型和POP909-CL标注”,表明训练好的模型权重会公开。

- 数据集:论文明确表示将发布POP909-CL数据集。这是对原POP909数据集的增强版本,包含人工校正的标注。

- Demo:提供在线演示网站:

https://andyweasley2004.github.io/BACHI/。 - 复现材料:论文提供了详细的训练设置(优化器、学习率调度、数据增强等关键超参数),这为复现实验提供了充分信息。

- 论文中引用的开源项目:论文引用了music21工具包,用于将罗马数字和弦标注转换为绝对和弦标签。

📌 核心摘要

- 问题:现有符号(乐谱)和弦识别(ACR)研究面临两大挑战:一是缺乏高质量、大规模标注的符号音乐数据集;二是现有模型方法未充分考虑并模拟人类音乐分析的渐进过程。

- 方法核心:提出BACHI模型,将和弦识别分解为两步:(1) 边界检测:使用Transformer编码器预测和弦变化点,并通过特征线性调制(FiLM)将边界信息注入到上下文表示中;(2) 置信度引导的迭代解码:使用一个Transformer解码器,迭代地填充被遮蔽的和弦元素(根音、性质、低音),每一步都优先选择当前置信度最高的元素进行预测。

- 创新点:与先前方法(如直接预测完整和弦标签或使用固定顺序解码)相比,BACHI引入了显式的边界感知模块和灵活的、数据驱动的迭代解码顺序,更贴合人类和弦分析的思维方式。

- 主要实验结果:在古典音乐(DCML+WiR)和新发布的流行音乐(POP909-CL)数据集上,BACHI在全和弦准确率(Full Chord Accuracy)上均取得了最佳性能。古典音乐:BACHI(68.1%)相比最佳基线(Harmony Transformer v2的62.1%)提升了6.0个百分点。流行音乐:BACHI(82.4%)与Harmony Transformer v2(82.2%)相当,但优于其他基线。消融实验证明了边界检测(BD)和迭代解码(ID)模块的贡献。

- 实际意义:提供了更可靠的流行音乐和弦标注数据集(POP909-CL),并为符号MIR任务(如音乐分析、和弦条件音乐生成、音乐教育)提供了更强的基础模型。

- 主要局限性:模型目前仅在钢琴编曲的符号音乐上验证,对更复杂的多声部、多乐器总谱的适用性未知;在流行音乐上相对SOTA的提升有限;其性能上限仍受制于符号音乐数据总量和标注一致性。

🏗️ 模型架构

BACHI是一个两阶段的深度学习模型,整体流程如图1所示。

- 输入与预处理:

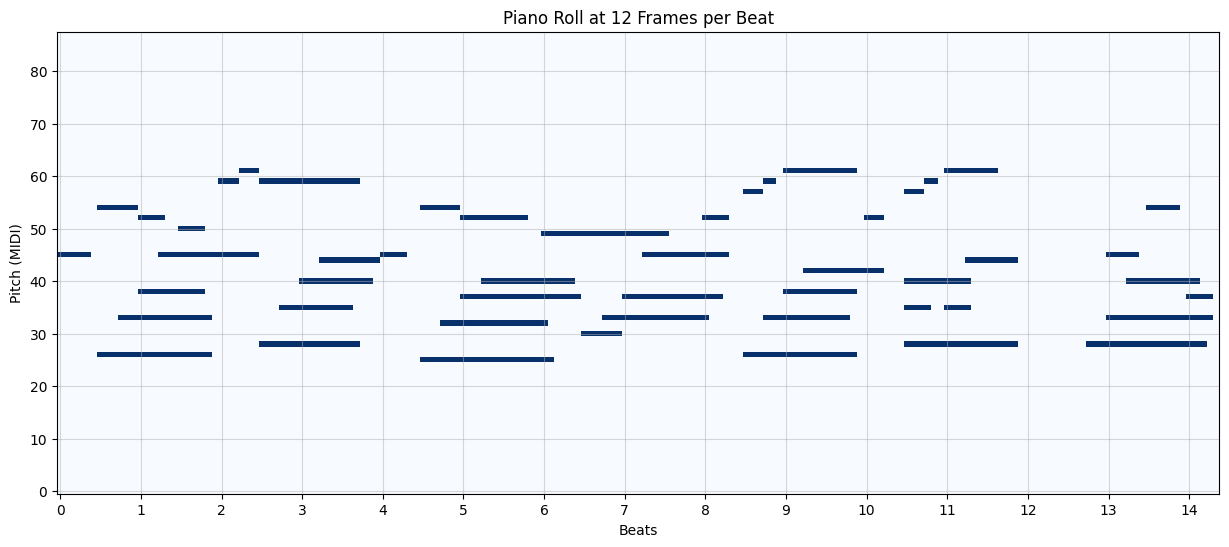

- 输入:符号音乐乐谱,表示为钢琴卷帘(Piano Roll)矩阵

P ∈ {0,1}^{T×88},T是时间帧数(12帧/拍),88代表音高。 - 补丁嵌入(Patch Embedding):通过一个1D-CNN层(核大小6)将88维音高通道映射为

d_model=512维的潜在向量,同时将时间维度T压缩为T/6。随后通过一个GLU激活层,得到离散时间步(每拍6个子步)的token序列X。这相当于将乐谱切分成固定长度的“小节”。

- 主干编码器(Model Backbone):

- token序列

X被送入6层Transformer编码器。输出为每个时间步的隐藏状态H。

- 边界检测与条件化(Boundary Detection & Conditioning):

- 一个MLP头基于编码器输出

H预测每个时间步的和弦变化边界概率e(由和弦标签二值化得到)。 - 采用特征线性调制(FiLM) 将边界信息

e与编码器特征H融合。具体地,H和e拼接后,通过两个MLP分别生成缩放因子γ和偏置β,然后对H进行调制:Z = LayerNorm(H) ⊙ (1 + γ) + β。这使得模型能够利用边界信息来调节每个时间步的特征表示,例如在可能的边界处增强特征。

- 置信度引导的迭代解码器(Confidence-Ordered Decoding):

- 解码器输入:每个时间步

t的最终输入C_t由当前帧的调制特征Z_t和其局部邻域(t±2)的原始编码器特征H拼接而成,即C_t ∈ R^{6×d_model}。这融合了边界信息、局部上下文和当前帧的原始和弦特征。 - 解码器结构:一个单层Transformer解码器块,包含自注意力(SA)和交叉注意力(CA)。自注意力在解码器自身的输入序列上操作,交叉注意力则关注上述拼接好的上下文

C_t。 - 输出:解码器为每个时间步输出三个潜在表示

X_t ∈ R^{3×d_model},分别对应根音、和弦性质、低音(转位)。每个表示后接一个分类头,输出对应的logit。 - 训练(掩码预测):训练时,解码器的输入

X_m_t是真实和弦元素随机遮蔽(替换为[MASK])后的版本。模型被训练去预测被遮蔽的元素。损失函数为标准的分类交叉熵(论文未明确说明,但由任务性质可推断)。 - 推理(迭代解码):

- 初始化解码器输入为全[MASK]。

- 计算三个未填充元素(根音、性质、低音)预测的置信度(即softmax概率的最大值)。

- 将置信度最高的元素的预测结果“提交”(填充到对应位置)。

- 重复步骤2-3,直到三个元素全部被预测(共迭代3次)。这个顺序完全由数据本身在当前时间步的置信度动态决定。

💡 核心创新点

- 边界感知的特征调制:提出使用FiLM机制将显式预测的和弦变化边界信息融入到编码器特征中。这解决了传统方法忽略音乐结构边界、导致和弦切换处识别不准确的问题。

- 模仿人类耳练的置信度迭代解码:摒弃了固定顺序(如先根音后性质)的解码方式,而是让模型在每一步动态选择当前最确定的元素进行预测。这种自适应顺序模拟了音乐家听辨和弦时“从最明显线索入手”的过程,提升了整体识别准确率。

- 构建高质量符号音乐基准数据集(POP909-CL):针对现有数据集标注错误多、节奏不齐的问题,创建了经过专业音乐家校对的POP909-CL,包含准确的和弦、节拍、调号和拍号标签,为符号MIR研究提供了可靠资源。

🔬 细节详述

- 训练数据:

- 古典音乐:合并When-in-Rome (WiR) 和DCML数据集,去除重复后约1500首作品。将原罗马数字分析标注转换为绝对和弦标签。

- 流行音乐:POP909-CL,909首中文流行歌曲的钢琴MIDI,经人工校正标签。

- 数据增强:对训练集进行12调性移调增强。测试集仅用原调。

- 数据集划分:每个数据集采用9:1的训练-测试划分。

- 损失函数:论文未明确说明,推测为和弦元素(根音、性质、低音)分类的交叉熵损失。

- 训练策略:

- 优化器:AdamW(β1=0.9, β2=0.98, eps=1e-9)。

- 学习率:采用线性预热(古典4000步,流行2000步)后接余弦衰减,范围1e-5到1e-4。

- 批处理与精度:使用bfloat16混合精度训练,最大梯度范数裁剪为2.0。

- 训练方式:古典音乐和流行音乐分别训练独立的模型,不进行跨流派联合训练。

- 关键超参数:

- 模型维度:

d_model = 512。 - 编码器:6层Transformer编码器。

- 解码器:1层Transformer解码器。

- 输入分辨率:12帧/拍,补丁嵌入后为6个token/拍。

- 模型维度:

- 训练硬件:未说明。

- 推理细节:采用上述置信度迭代解码策略,无温度调整或beam search。

- 正则化:未提及额外的正则化技巧(如Dropout),但混合精度训练和梯度裁剪有助于稳定训练。

📊 实验结果

主要对比实验(表1):

| 模型/方法 | 古典音乐语料库 Root | Quality | Bass | Full | POP909-CL Root | Quality | Bass | Full |

|---|---|---|---|---|---|---|---|---|

| Rule-based [16] | 54.6 | 45.8 | 50.5 | 28.4 | 85.9 | 69.7 | 85.8 | 65.0 |

| AugmentedNet [13] | 73.9 | 74.2 | 72.3 | 57.2 | 88.6 | 84.5 | 90.5 | 78.7 |

| ChordGNN [12] | 73.0 | 73.7 | 71.0 | 58.5 | 80.7 | 82.0 | 82.7 | 71.6 |

| Harmony Transformer v2 [15] | 76.1 | 76.8 | 75.2 | 62.1 | 90.5 | 86.9 | 92.1 | 82.2 |

| BACHI (ours) | 77.8 | 79.0 | 77.0 | 68.1 | 89.6 | 86.8 | 91.3 | 82.4 |

(指标为每首曲子的宏观准确率 (%)) 关键结论:

- 在古典音乐上,BACHI在所有指标上均为最优,特别是全和弦准确率(68.1%)大幅领先第二名(62.1%)达6.0个百分点。

- 在流行音乐(POP909-CL)上,BACHI取得最佳全和弦准确率(82.4%)和性质准确率(86.8%),但根音和低音准确率略低于Harmony Transformer v2。

- 规则基线在POP909-CL上仅达65.0%准确率,而使用BACHI可达82.4%,这间接证实了人工标注的POP909-CL数据集比原始POP909更可靠(原始算法标注的准确率上限约65%)。

消融实验(表2,古典音乐语料库):

| 模型设计 | Root | Quality | Bass | Full Chord |

|---|---|---|---|---|

| BACHI w/o. BD and ID | 78.0 | 78.9 | 77.3 | 66.1 |

| BACHI w/o. ID | 77.8 | 78.8 | 76.8 | 65.6 |

| BACHI w/. key detection | 77.4 | 78.6 | 76.4 | 67.6 |

| BACHI | 77.8 | 79.0 | 77.0 | 68.1 |

关键结论:

- 去掉边界检测(BD)和迭代解码(ID),模型退化为标准Transformer编码器,全准确率降至66.1%。

- 单独去掉迭代解码(ID),性能进一步降至65.6%,表明迭代解码的贡献显著。

- 加入额外的调号检测条件(key detection)并未提升性能(67.6%),可能因调号预测误差传播导致。

分析图表(图3):

关键结论:流行音乐的错误主要集中在大/小三和弦的混淆,而古典音乐的错误分布更广泛,反映了古典音乐和声的复杂性和标注模糊性。

关键结论:流行音乐的错误主要集中在大/小三和弦的混淆,而古典音乐的错误分布更广泛,反映了古典音乐和声的复杂性和标注模糊性。

其他结果:论文提到,置信度解码顺序在不同音乐风格中呈现不同模式:古典音乐倾向于先预测性质(Quality),而流行音乐倾向于先预测低音(Bass),这为模型决策提供了可解释性。

⚖️ 评分理由

- 学术质量(6.5/7):创新性��现在将音乐分析认知过程(边界、逐步解码)成功融入深度学习模型架构。技术实现严谨,基于成熟的Transformer。实验对比充分,在关键数据集上达到SOTA,消融研究验证了设计动机。主要不足是创新组合性较强,理论贡献深度一般。

- 选题价值(1.0/2):聚焦符号音乐和弦识别这一专业且基础的MIR任务,对音乐技术生态有实用价值。但任务受众和影响力远小于语音识别、通用音频理解等主流领域。

- 开源与复现加成(0.0/1):论文明确承诺开源代码、模型和数据集,并提供演示网站链接,可复现性极高。