📄 AVO-65: A Large-Scale Hierarchical Audio-Visual Object Dataset

#音视频 #数据集 #多模态模型 #模型评估

✅ 7.0/10 | 前50% | #音视频 | #数据集 | #多模态模型 #模型评估

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:未说明(论文中注明“† These authors contributed equally”,但未明确排序)

- 通讯作者:Dongchen Zhu12, (注有号)

- 作者列表:Zehao Yao1,2,†; Guanghui Zhang1,†; Lei Wang1,2; Dongchen Zhu1,2,* (注1:1为Bio-Vision System Laboratory, Science and Technology on Micro-system Laboratory, Shanghai Institute of Microsystem and Information Technology, Chinese Academy of Sciences; 2为University of Chinese Academy of Sciences)

💡 毒舌点评

这篇论文的亮点在于提出了一套严谨、系统化的多模态数据集构建流程,并特别强调了音视频“多重一致性”和层次化标注,填补了现有数据集的空白。然而,其短板也十分明显:论文的核心贡献本质上是一个高质量的“工程产物”(数据集),而在算法、模型或理论层面几乎没有提出新的方法,实验部分主要使用现成的模型进行基线测试,创新性不足。

🔗 开源详情

- 代码:论文明确提供了代码仓库链接:https://github.com/siyunye/AVO-65。

- 模型权重:论文中未提及公开预训练模型权重。

- 数据集:论文明确提供了数据集的获取方式(通过同一GitHub链接),并声明数据集公开可用。

- Demo:论文中未提及在线演示。

- 复现材料:论文在“实验设置”和“训练与验证细节”部分详细描述了数据预处理(音频/视频)、训练超参数(优化器、学习率、批大小、轮数、调度策略)和评估指标,为复现提供了必要信息。

- 论文中引用的开源项目:使用了VIA标注工具(引用[19]),并在相关工作部分引用了多个开源数据集和模型(如AudioSet, VGGSound, Kinetics等)。

📌 核心摘要

- 问题:现有音视频数据集大多以单一模态(视觉或音频)为中心,难以满足多模态学习中对语义、时域和空间一致性的多重要求,引入了训练噪声,限制了模型性能。

- 方法核心:设计并实施了一个四阶段(定义类别与收集视频、人工验证与标注、数据检查与合并、多粒度层次标注)的数据收集与标注流程,构建了以“音视频物体”为中心、给予两种模态同等地位的AVO-65数据集。

- 新颖之处:与先前以单模态为中心或规模有限的数据集相比,AVO-65通过流程设计确保了多重一致性,并采用了基于霍恩博斯特尔-萨克斯(H-S)分类法的四层(5、11、16、65个类别)层次化标签,提供了多粒度的监督信息。

- 主要结果:

- 数据集规模:包含30154个视频片段(总时长83.3小时),覆盖65个类别。

- 基线性能:在Level-4(细粒度)分类任务上,使用Gated融合的VGG16模型达到了最佳Top-1准确率75.829%。音视频融合模型(如UAVM,Top-1: 76.275%)普遍优于单模态模型(音频最佳VGG16: 73.750%;视觉最佳ResNet50: 49.348%)。随着标签层级变细,所有模型性能均下降。关键数据见下表。

| 模型 | 融合方式 | Top-1(%) | Top-5(%) | mAP | mAUC | d-prime |

|---|---|---|---|---|---|---|

| VGG16 (AV) | Gated | 75.565 | 94.258 | 0.740 | 0.987 | 3.355 |

| ResNet50 (AV) | Concat | 75.449 | 93.664 | 0.751 | 0.987 | 3.374 |

| UAVM (AV) | - | 76.275 | 94.011 | 0.753 | 0.988 | 3.394 |

- 实际意义:为音视频学习领域提供了一个具有多重一致性和层次化标签的大规模基准数据集,有望促进相关任务(如识别、分离、生成、检测等)的算法研究与发展。

- 主要局限性:论文的主要贡献集中于数据集本身,而非提出新的学习算法。实验部分主要评估了现有模型在该数据集上的性能,未深入探索利用其“多重一致性”或“层次标签”进行模型设计的具体方法。数据分布呈长尾,部分类别样本较少。

🏗️ 模型架构

本文并非提出一种新的神经网络模型,而是描述了一个数据集构建与标注流程的架构。其核心是构建一个高质量、多层次标注的音视频数据集AVO-65。

完整流程(对应论文第4节):

- 阶段一:获取类别列表与候选视频:基于H-S乐器分类和现有数据集,制定初步的约200个音视频物体类别列表。通过YouTube搜索关键词变体(如“动词+名词”、“名词+声音”、多语言翻译、同义词替换)下载超过10万个候选视频。

- 阶段二:人工验证与数据标注:15名专业标注员使用VIA工具进行标注。标注流程强制先单独听音频,再单独看视频,最后结合两者判断,以确保单模态判断的独立性,减少跨模态干扰。重点保留符合多重一致性的“音视频物体”样本,并允许存在“音频物体”、“视觉物体”及列表外的噪声以增强鲁棒性。标注内容包括类别和时间段。

- 阶段三:数据检查与合并:对标注不一致的样本进行重标注(需4人同意才保留)。合并所有标注正确的样本,最终得到65个类别共30154个样本。

- 阶段四:多粒度层次标注:基于H-S乐器发声机制分类法,为每个类别构建四层层次树(图3),提供从粗粒度(5个大类)到细粒度(65个具体类别)的多层次标签。

关键设计选择及动机:

- 音视频物体中心化:为了解决单模态数据集带来的不一致性噪声问题。

- 分模态标注与验证:为确保模态独立性,避免一种模态主导判断。

- 保留困难样本:允许模态缺失、列表外物体共存,以提高模型的鲁棒性和泛化能力。

- 层次化标签:为了支持多粒度学习,并揭示类别间的语义关系(如同源发声机制)。

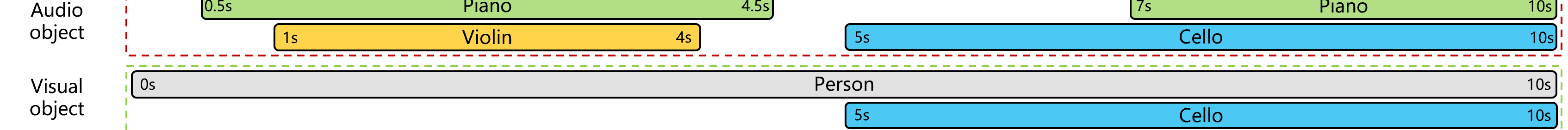

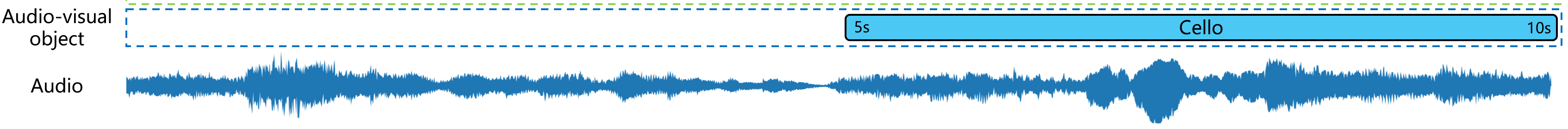

图1展示了一个音视频物体(大提琴)在视频中的四种可能状态(同时可见可闻、仅可闻、仅可见、其他)。这直观说明了音视频时域对应可能不完全同步,是构建数据集时需要处理的核心问题之一。

图1展示了一个音视频物体(大提琴)在视频中的四种可能状态(同时可见可闻、仅可闻、仅可见、其他)。这直观说明了音视频时域对应可能不完全同步,是构建数据集时需要处理的核心问题之一。

图3清晰地展示了基于H-S分类法的四层层次树结构,以“Cello(大提琴)”为例,其路径为:第1层 Chordophones(弦乐器)-> 第2层 Composite chordophones(复合弦乐器)-> 第3层 Lutes(琉特琴类)-> 第4层 Cello。这体现了数据集如何为每个细粒度类别提供多层次的语义信息。

图3清晰地展示了基于H-S分类法的四层层次树结构,以“Cello(大提琴)”为例,其路径为:第1层 Chordophones(弦乐器)-> 第2层 Composite chordophones(复合弦乐器)-> 第3层 Lutes(琉特琴类)-> 第4层 Cello。这体现了数据集如何为每个细粒度类别提供多层次的语义信息。

💡 核心创新点

- 以音视频物体为中心的数据构建理念:明确将音频和视觉模态视为平等,围绕“同时可见可闻的物体”组织数据,并主动保留单模态出现或缺失的样本。这与以往以视觉为主(如Kinetics)或以音频为主(如VGGSound)的数据集有根本区别,旨在更好地服务于需要跨模态对齐与互补的任务。

- 确保多重一致性的系统化标注流程:设计并实施了强制先单模态后双模态验证的四阶段标注流程。该流程通过程序设计(如禁止在单模态判断后修改、随机分配标注员、重标注机制)来尽可能减少主观偏差和跨模态干扰,从方法论上保障了语义、时域和空间一致性。

- 基于科学分类法的多粒度层次标签:借鉴乐器分类的H-S体系,为数据集构建了一个四层的层次标签树。这不仅提供了丰富的语义层次信息,使得同一类别的样本在不同粒度下都有标签,也为研究层次化音视频学习提供了数据基础。

- 构建首个大规模、多层次且兼顾一致性的音视频基准数据集:在规模(30K视频,83小时)、类别覆盖(65类)和标签质量(多重一致性验证)上,相比现有的AVE、LLP等考虑双模态的数据集有显著提升,填补了该领域的空白。

🔬 细节详述

- 训练数据:数据集为AVO-65。训练集包含24093个片段,测试集包含6061个片段。数据来源为YouTube真实场景视频。预处理:音频下采样至16kHz,取随机5.12秒片段转换为128×512的对数梅尔频谱图;视频按1秒1帧提取,缩放至224×224,并应用随机水平翻转和裁剪进行增强。对于短于10秒的片段,音视频均采用复制拼接后截取前10秒的方式处理。

- 损失函数:论文未提及使用了特殊的损失函数,默认采用标准的交叉熵损失。

- 训练策略:训练100个epoch,批大小32。使用随机梯度下降(SGD)优化器,动量0.9,权重衰减10⁻⁴。初始学习率10⁻⁴,前5个epoch线性预热至10⁻³,然后采用余弦退火策略调整学习率。

- 关键超参数:使用的基线模型为ResNet-50和VGG-16。音频输入为128×512的对数梅尔频谱图。训练时随机裁剪5.12秒音频,测试时取中心5.12秒。视频输入为224×224图像。

- 训练硬件:未说明。

- 推理细节:未说明具体的解码策略、温度等生成细节。对于分类任务,使用softmax层输出。

- 正则化或稳定训练技巧:未明确提及除数据增强(随机翻转、裁剪)外的其他正则化技巧。

📊 实验结果

论文在Level-4(最细粒度,65类)任务上评估了多种模型和融合方法。

单模态识别结果(表3):

| 模型 | 模态 | Top-1(%) | Top-5(%) | mAP | mAUC | d-prime |

|---|---|---|---|---|---|---|

| ResNet50 | 音频 (A) | 71.836 | 91.817 | 0.711 | 0.981 | 3.140 |

| ResNet50 | 视觉 (V) | 49.348 | 76.819 | 0.416 | 0.928 | 2.133 |

| VGG16 | 音频 (A) | 73.750 | 93.202 | 0.718 | 0.980 | 3.123 |

| VGG16 | 视觉 (V) | 47.533 | 75.186 | 0.390 | 0.913 | 1.982 |

结论1:音频单模态性能显著优于视觉单模态。这可能因为许多音视频物体(如乐器)的视觉特征较小或易受背景干扰,而其声音特征更具辨识度。

不同融合方法的音视频识别结果(表4):

| 模型 | Top-1(%) | Top-5(%) | ||||||

|---|---|---|---|---|---|---|---|---|

| Sum | Concat | Gated | FiLM | Sum | Concat | Gated | FiLM | |

| VGG16 | 75.483 | 75.829 | 75.565 | 74.080 | 94.522 | 94.143 | 94.258 | 94.341 |

| ResNet50 | 74.790 | 75.449 | 73.552 | 73.618 | 93.532 | 93.664 | 93.318 | 92.839 |

结论2:融合模型普遍优于单模态模型。其中,Concat和Gated融合方法整体表现优于Sum和FiLM。

不同层级(Granularity)的识别结果(表5):以VGG16模型为例。

| 模态 | 第一层Top-1(%) | 第二层Top-1(%) | 第三层Top-1(%) |

|---|---|---|---|

| 音频 (A) | 87.560 | 83.351 | 82.214 |

| 视觉 (V) | 69.032 | 64.247 | 62.712 |

| 音视频 (AV) | 86.675 | 84.837 | 83.567 |

结论3:随着标签粒度变细(从第一层到第三层),所有模态的性能均下降,因为细粒度识别需要更具区分性的特征。

其他常见识别模型结果(表6):

| 模型 | 模态 | Top-1(%) | Top-5(%) | mAP | mAUC | d-prime |

|---|---|---|---|---|---|---|

| AudioSlowFast | A | 72.447 | 91.932 | 0.718 | 0.982 | 3.150 |

| SlowFast | V | 52.153 | 78.155 | 0.442 | 0.933 | 2.210 |

| MBT | AV | 76.143 | 94.077 | 0.754 | 0.988 | 3.369 |

| UAVM | AV | 76.275 | 94.011 | 0.753 | 0.988 | 3.394 |

结论4:专门的音视频多模态模型(MBT, UAVM)性能优于基线CNN融合模型。UAVM在Top-1准确率上达到了最高值。

图2展示了65个类别的样本数量分布,呈长尾形态,头部类别(如“piano”)样本超过1600个,尾部类别样本不足30个。这反映了真实世界数据分布的特点,也为模型的泛化能力提出了挑战。

图2展示了65个类别的样本数量分布,呈长尾形态,头部类别(如“piano”)样本超过1600个,尾部类别样本不足30个。这反映了真实世界数据分布的特点,也为模型的泛化能力提出了挑战。

⚖️ 评分理由

- 学术质量(6.0/7):论文提出了一套完整、严谨的数据集构建方法论,流程设计合理,实验部分提供了充分的基线数据和多角度评估。技术正确性高,证据可信。扣分主要在于核心贡献是数据集工程,而非算法创新,学术新颖性相对有限。

- 选题价值(1.5/2):解决音视频学习领域缺少兼顾一致性与层次性的大规模基准数据集的问题,选题具有明确的前沿性和重要性。数据集的发布能直接推动多个下游任务的研究,具有较高的实际应用价值和影响力。

- 开源与复现加成(0.5/1):论文明确开源了代码和数据集,并提供了详细的训练超参数和实验设置,复现友好度较高。但缺少对模型权重、训练硬件(GPU型号/数量/时长)的详细说明,略有遗憾。