📄 Auditory Illusion Benchmark for Large Audio Language Models

#模型评估 #基准测试 #音频大模型 #听觉认知

✅ 7.0/10 | 前50% | #模型评估 | #基准测试 | #音频大模型 #听觉认知

学术质量 5.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Hayoon Kim(首尔大学音乐与音频研究组,首尔大学智能信息学系)

- 通讯作者:Kyogu Lee(首尔大学音乐与音频研究组,首尔大学智能信息学系,AIIS,IPAI)

- 作者列表:Hayoon Kim(首尔大学音乐与音频研究组,首尔大学智能信息学系)、Eunice Hong(首尔大学音乐与音频研究组,首尔大学智能信息学系)、Kyogu Lee(首尔大学音乐与音频研究组,首尔大学智能信息学系,AIIS,IPAI)

💡 毒舌点评

亮点:论文首次将认知科学中的“听觉错觉”概念系统化为评估大型音频语言模型(LALMs)的基准,方法严谨(包含对照组和人类基线),指出了模型在“感知”层面与人类的关键差距,角度新颖且具有启发性。短板:所有评估任务被压缩为简单的二选一或三选一,这种简化可能无法充分捕捉复杂听觉错觉的微妙体验和动态过程;对模型内部为何产生差异的分析停留在表面,缺乏更深入的机理解释。

🔗 开源详情

- 代码:提供了生成AIB错觉刺激的开源代码仓库:

https://github.com/gillosae/aib。 - 模型权重:未提及。论文评估的是已公开的模型(如Qwen2-Audio, MuLLaMa等),未提出或开源新的模型权重。

- 数据集:是,已公开。论文声明AIB基准数据集已通过上述GitHub仓库公开发布。

- Demo:未提及。

- 复现材料:提供了数据集和刺激生成代码,复现评估结果需要访问被评估的模型及其权重(这些通常是公开的)。论文未提供详细的评估脚本或配置文件。

- 论文中引用的开源项目:引用了多个被评估模型的开源项目,如Pengi、Audio Flamingo、MuLLaMa、Qwen-Audio等。

📌 核心摘要

- 要解决什么问题:当前对大型音频语言模型(LALMs)的评估主要集中在识别准确性等客观任务上,缺乏评估其是否内化了人类特有的感知偏差(如对听觉错觉的易感性)的方法。本文旨在填补这一空白。

- 方法核心是什么:提出了首个听觉错觉基准(AIB),包含10种代表性听觉错觉(分为基于物理和基于物理+知识两类),涵盖音乐、声音和语音领域。将每个错觉的感知判断转化为多项选择题,并与控制刺激一起,对多款LALMs和人类被试(20名绝对音感者)进行平行测试。

- 与已有方法相比新在哪里:AIB是首个专门为LALMs设计的听觉错觉评估基准。与主要关注准确率或推理的现有音频基准不同,AIB的核心目标是衡量模型的“人类感知对齐度”(通过ISI等指标),即模型是否像人类一样“犯错”。

- 主要实验结果如何:人类被试在各类错觉上均表现出极高的易感性(ISI≈0.8-0.9)。LALMs的表现则系统性地分化:在“基音缺失”等低级声学错觉上,Qwen2-Audio表现出近人类易感性(ISI>0.9);在需要结合知识的错觉(如谢泼德音调)上,大模型(如MuLLaMa)显示出部分对齐,但整体仍弱于人类;在语音相关错觉(语音转歌曲、音素恢复)上差距最大,仅Qwen2-Audio在音素恢复上达到完美人类对齐,但所有模型在语音转歌曲上均失败。详细结果见下表。

- 实际意义是什么:为评估和开发更具“人感”的音频AI模型提供了新的诊断维度和工具。有助于推动模型从追求信号保真度向模拟人类认知特性发展,并为认知科学提供对比人类与机器感知的实验平台。

- 主要局限性是什么:评估任务被简化为固定的多项选择题,可能无法全面评估错觉感知的丰富性。许多模型在控制条件下性能也不稳定,表明其基础音频理解能力仍有不足。论文未深入探讨模型架构或训练方式导致差异的具体原因。

实验结果表格:

| 模型 | 参数量 | Physics (幻觉) HLA/RA/ISI | Physics (控制) HLA/RA/ISI | Physics+Knowledge (幻觉) HLA/RA/ISI | Physics+Knowledge (控制) HLA/RA/ISI | 总体平均 HLA/RA/ISI |

|---|---|---|---|---|---|---|

| Human | - | 1.000/0.000/1.000 | 1.000/1.000/0.000 | 1.000/0.000/1.000 | 1.000/1.000/0.000 | 1.000/0.000/1.000 |

| Pengi | 323M | 0.677/0.323/0.355 | 0.333/0.389/-0.056 | 0.715/0.285/0.430 | 0.083/0.224/0.141 | 0.408/0.296/0.112 |

| Audio Flamingo Chat | 2.2B | 0.925/0.075/0.875 | 0.120/0.139/-0.019 | 0.963/0.037/0.926 | 0.245/0.217/0.028 | 0.901/0.056/0.845 |

| MuLLaMa | 7B | 0.535/0.465/0.070 | 0.155/0.167/-0.012 | 0.856/0.144/0.711 | 0.084/0.217/0.133 | 0.519/0.240/0.279 |

| Qwen-Audio-Chat | 8.4B | 0.305/0.695/-0.389 | 0.267/0.222/0.045 | 0.567/0.433/0.133 | 0.083/0.217/0.134 | -0.023/0.512/-0.535 |

| Qwen2-Audio | 8.4B | 0.985/0.015/0.971 | 0.015/0.111/-0.096 | 0.744/0.256/0.489 | 0.083/0.217/0.134 | 0.633/0.183/0.450 |

| Qwen2-Audio-Instruct | 8.4B | 0.182/0.818/-0.636 | 0.314/0.222/0.092 | 0.470/0.530/-0.059 | 0.088/0.217/0.129 | -0.232/0.616/-0.848 |

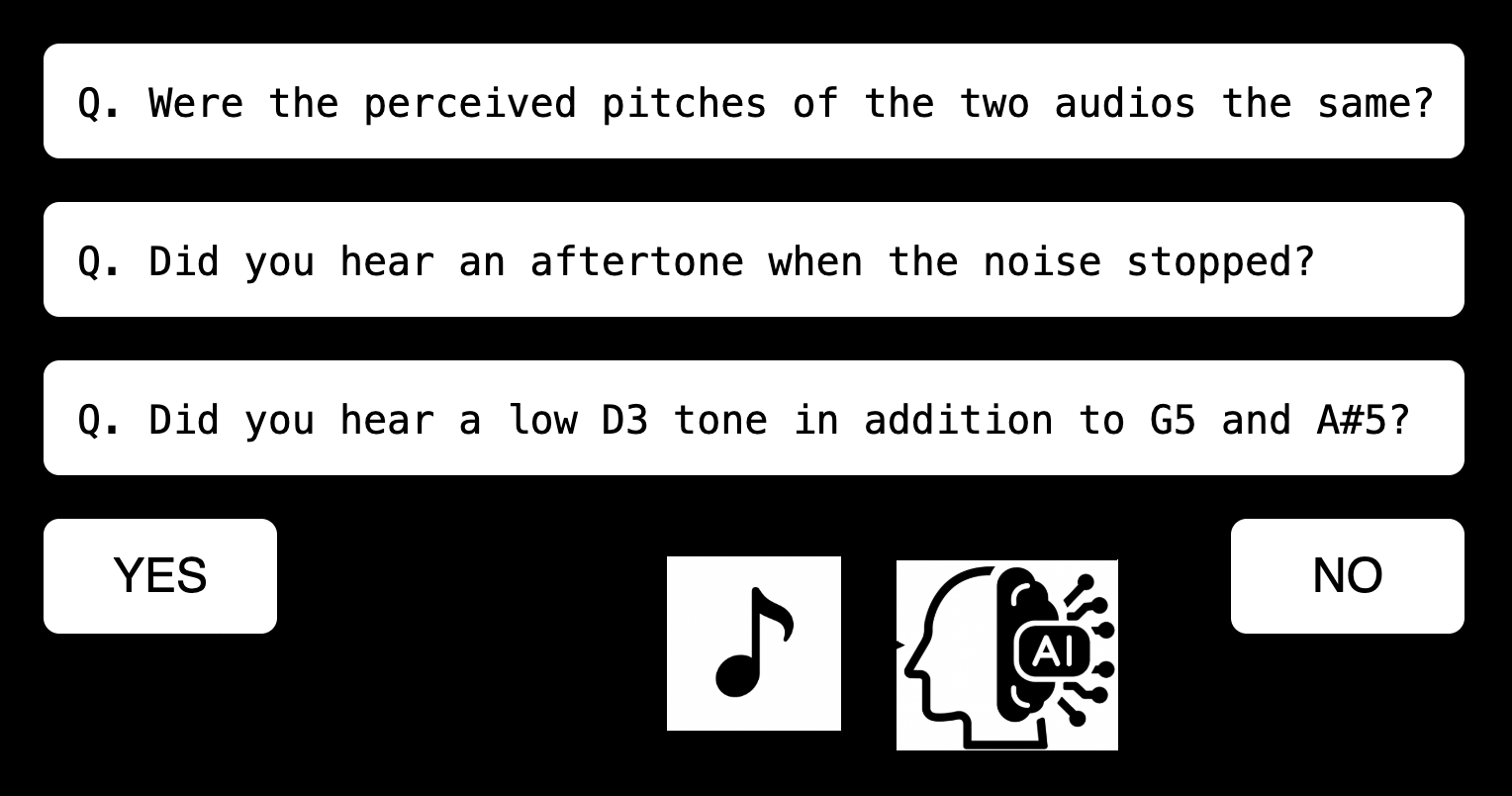

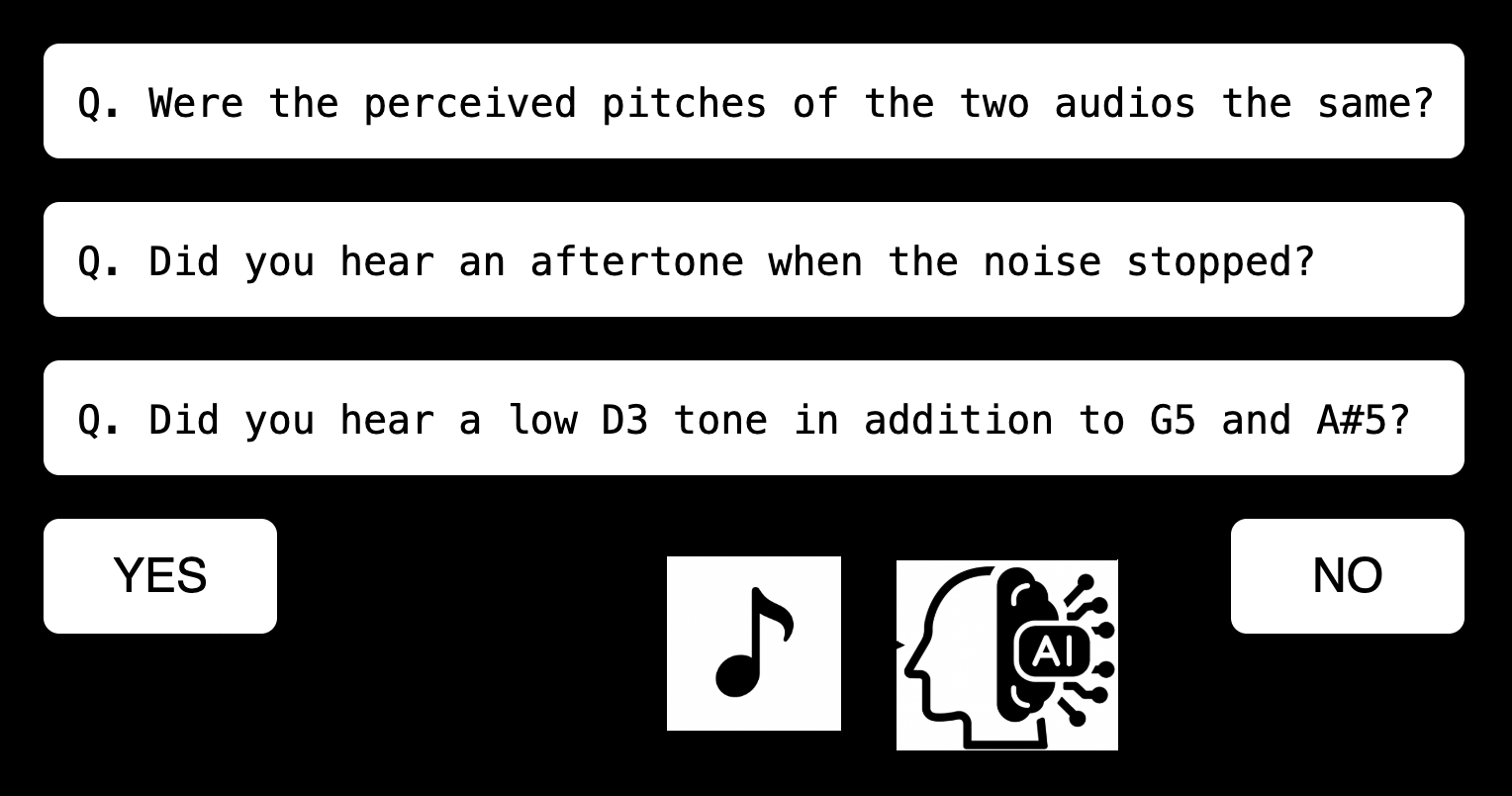

图1展示了AIB中三个错觉刺激(基音缺失、Zwicker音调、Tartini音调)及其对照刺激的示例,以及用于查询人类和AI模型的提示格式。这直观地说明了如何将听觉错觉感知转化为可评估的任务。

图1展示了AIB中三个错觉刺激(基音缺失、Zwicker音调、Tartini音调)及其对照刺激的示例,以及用于查询人类和AI模型的提示格式。这直观地说明了如何将听觉错觉感知转化为可评估的任务。

🏗️ 模型架构

本文并未提出新的模型架构,而是评估了一系列现有的大型音频语言模型(LALMs)。被评估的模型包括:

- Pengi:一个323M参数的音频语言模型。

- Audio Flamingo Chat:一个2.2B参数的模型,具备上下文学习和对话能力。

- MuLLaMa:一个7B参数的音乐理解LLaMA模型。

- Qwen-Audio-Chat / Qwen2-Audio / Qwen2-Audio-Instruct:均为8.4B参数的Qwen-Audio系列模型,其中Instruct版本经过指令微调。

- Gemini Pro v1.5:Google的大型多模态语言模型(参数量未说明)。

- 作为基线,还包括“随机猜测”和“最常见选择”策略。

评估流程是:将AIB中的听觉错觉刺激(已转为音频)和对应的多项选择题提示输入到每个LALM中,获取模型的文本选择答案。然后将这些答案与人类被试(20名绝对音感者)的判断结果进行分布比较,计算HLA、RA和ISI指标。论文中未提供架构图。

💡 核心创新点

- 提出首个听觉错觉评估基准(AIB):之前缺乏专门用于评估LALMs是否感知听觉错觉的系统化基准。AIB首次涵盖了10种代表性错觉,并按底层机制和感知领域进行了科学分类。

- 建立人机可比的评估范式:将主观的听觉错觉感知转化为客观的、可量化的多项选择任务,并提供了严格控制的人类基线数据,使得模型性能可以与人类进行直接、公平的比较。

- 揭示LALMs的感知对齐差异:通过实验发现,LALMs在感知听觉错觉方面与人类存在系统性差异。模型对低级声学特征的错觉捕捉能力相对较强,但对需要结合知识、经验和语言先验的高级错觉(尤其是语音类错觉)的易感性普遍不足,且表现受模型架构和训练方式影响显著。

🔬 细节详述

- 训练数据:未说明。本文是评估工作,不涉及新模型的训练。评估使用的AIB数据集包含8635个错觉刺激和2890个控制刺激。

- 损失函数:不适用。

- 训练策略:不适用。

- 关键超参数:未说明。仅提及了被评估模型的参数量(如323M, 7B等)。

- 训练硬件:未说明。

- 推理细节:未说明。论文未详述模型推理时的具体解码策略(如温度、beam size)。

- 正则化或稳定训练技巧:不适用。

- 人类实验细节:招募了20名具有绝对音感的参与者,在安静环境下使用耳机通过网页界面进行随机顺序试次测试,报告分类判断(如‘上’ vs ‘下’)。采用多数投票聚合响应。

📊 实验结果

主要评估在AIB的test-mini子集上进行,结果汇总于上文核心摘要部分的表格。关键发现包括:

- 物理类错觉:人类易感性极高(ISI=1.0)。Qwen2-Audio表现最佳,达到近人类水平(ISI=0.971)。Audio Flamingo Chat也表现出色(ISI=0.875)。其他模型表现中等或较差。

- 物理+知识类错觉:人类易感性同样极高(ISI=1.0)。Audio Flamingo Chat表现最好(ISI=0.926),MuLLaMa次之(ISI=0.711)。但Qwen2-Audio-Instruct表现出严格的物理对齐(ISI=-0.232)。

- 总体平均:人类ISI≈1.0。模型中,Audio Flamingo Chat的平均ISI最高(0.845),表明其整体上最容易产生人类式的感知偏差。MuLLaMa(0.279)和Qwen2-Audio(0.450)次之。Qwen-Audio-Chat和Qwen2-Audio-Instruct则表现出与物理事实的紧密对齐(负ISI)。

- 语音类错觉(细分):论文指出,人类在语音转歌曲和音素恢复上易感性极强。大多数模型在这两项上失败(ISI≈0)。唯一例外是Qwen2-Audio在音素恢复上达到完美人类对齐(ISI=1.0),但在语音转歌曲上依然失败。

此图(即图1)也展示了评估使用的典型刺激和问题格式,是理解实验设计的关键。

此图(即图1)也展示了评估使用的典型刺激和问题格式,是理解实验设计的关键。

⚖️ 评分理由

- 学术质量:5.0/7:创新性明确(新基准、新评估维度),方法设计合理(人机对比、控制组),实验结论有数据支持。但分析深度有限,对模型表现差异的解释较为表层,且评估任务的简化可能限制了结论的普适性。

- 选题价值:1.5/2:选题前沿且独特,将认知心理学工具引入AI评估,具有很高的启发性和跨学科价值。对于音频AI社区,这是一个评估模型“认知水平”的新方向。

- 开源与复现加成:0.5/1:积极开源了核心资产——AIB数据集和生成刺激的代码(https://github.com/gillosae/aib),极大提升了可复现性和社区贡献度。但未提供评估脚本或模型权重。