📄 AudioGen-Omni: A Unified Multimodal Diffusion Transformer for Video-Synchronized Audio, Speech, and Song Generation

#音频生成 #语音合成 #多模态模型 #扩散模型 #统一音频模型

✅ 7.5/10 | 前25% | #音频生成 | #多模态模型 | #语音合成 #扩散模型

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Le Wang(中国矿业大学,徐州)

- 通讯作者:未说明(论文中未明确标注通讯作者)

- 作者列表:Le Wang(中国矿业大学)、Jun Wang(快手科技,Kling AI)、Chunyu Qiang(快手科技,Kling AI)、Feng Deng(快手科技,Kling AI)、Chen Zhang(快手科技,Kling AI)、Kun Gai(快手科技,Kling AI)

💡 毒舌点评

亮点:这篇论文的野心很大,试图用一个统一的“全家桶”模型解决视频到音频、语音、歌曲的生成,并且通过全面的实验确实做到了在多个任务上刷榜,证明了其架构设计的有效性。 短板:然而,论文对视频输入的强依赖像一根“拐杖”,限制了其在无视频场景下的应用,而号称的“统一”框架在代码和模型完全黑箱的情况下,其宣称的优越性和可复现性都要打上一个问号。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及公开预训练模型权重。

- 数据集:论文提及了使用的多个数据集名称及大致规模,但未说明这些数据集是否由作者整理发布,或提供具体的下载/访问方式。部分数据集(如VGGSound, AudioCaps)是公开的,但作者处理后的版本未公开。

- Demo:提供了在线演示页面链接:https://ciyou2.github.io/AudioGen-Omni/ 。

- 复现材料:给出了模型总参数、层数、优化器、学习率、批次大小、GPU型号和训练时长等关键训练细节。但缺乏具体的网络层配置(如隐藏维度、注意力头数)、数据增强方法、评估脚本等,复现材料不充分。

- 论文中引用的开源项目:论文明确引用了并依赖以下开源模型或工具:F5-TTS [14], ConvNeXt-V2 [10], Synchformer [15], ViT-bigG (MetaCLIP) [31], T5-Base [30], Kling-Foley [32], VQ-CTAP [33], Qwen-Omni [27], Whisper [28], FunASR [29], FLUX [12], SD3 [11]。

📌 核心摘要

- 解决的问题:现有视频到音频(包括音效、语音、音乐)的生成方法大多任务特定、模型碎片化,且跨模态(如唇音同步)对齐效果不佳,限制了通用性和生成质量。

- 方法核心:提出AudioGen-Omni,一个基于多模态扩散变换器(MM-DiT)的统一框架。其核心是引入了“歌词-转录编码器”,将音素/字素映射为帧级稠密表示;并设计了“相位对齐各向异性位置注入(PAAPI)”,在注意力机制中对视频、音频、转录文本等有时序结构的模态选择性地应用旋转位置编码,以实现精细的跨模态同步。

- 创新点:a) 首个能同时处理音频、语音、歌曲生成的统一多模态条件生成框架;b) 提出了无需音素时长监督的歌词转录编码模块;c) PAAPI机制增强了细粒度的时序对齐。与先前工作不同,它解冻了所有模态并采用掩码输入策略,增强了灵活性。

- 主要实验结果:在VGGSound音频生成测试集上,其FD指标(PaSST 58.77, PANNs 6.29)优于MMAudio等基线(见表1)。在LRS3/LRS2语音生成测试中,其UTMOS(3.982/3.842)和DNSMOS(3.782/3.767)得分甚至超过真实语音,WER也大幅降低(17.56%/17.75%)(见表2)。在说话人相似度(SECS)评估中,其GE2E和VoxSim分数均高于其他方法(见表3)。模型能在1.91秒内生成8秒音频。

- 实际意义:为多媒体内容创作提供了一个高效、高质量的统一音频生成工具,有望简化视频后期制作流程,增强虚拟人物、游戏、社交媒体的音频沉浸感。

- 主要局限性:模型依赖视频输入,当无视觉信息时应用受限;论文未开源代码和模型,限制了社区复现和二次开发;虽能生成歌曲,但对复杂音乐结构的控制能力未深入展示。

🏗️ 模型架构

AudioGen-Omni是一个端到端的多模态扩散变换器,旨在根据可选的视频和文本输入,生成同步的音频、语音或歌曲。

图1 (a) 模型整体架构图:展示了所有组件及其交互。左侧为编码器部分,包括冻结的视觉编码器、文本编码器(Flan-T5)、梅尔编码器,以及可训练的歌词转录编码器(LT-Encoder)和投影层。中间是核心的多模态变换器块(MM-DiT),处理来自视频(V)、文本(T)、转录/歌词(C)和音频(A)的特征。右侧是梅尔解码器和损失计算部分。缺失模态(如纯文本生成)使用学习到的嵌入替代。

图1 (a) 模型整体架构图:展示了所有组件及其交互。左侧为编码器部分,包括冻结的视觉编码器、文本编码器(Flan-T5)、梅尔编码器,以及可训练的歌词转录编码器(LT-Encoder)和投影层。中间是核心的多模态变换器块(MM-DiT),处理来自视频(V)、文本(T)、转录/歌词(C)和音频(A)的特征。右侧是梅尔解码器和损失计算部分。缺失模态(如纯文本生成)使用学习到的嵌入替代。

完整输入输出流程:

- 输入编码:视频帧通过冻结的视觉编码器(如ViT-bigG)和时序对齐模块(Synchformer)得到帧级视觉特征。文本提示通过冻结的Flan-T5编码。转录/歌词文本通过可训练的“歌词-转录编码器”映射为密集的帧级表示。音频波形通过梅尔编码器编码为连续的潜在表示(如43Hz的潜在序列)。

- 特征投影与交互:所有模态的特征通过可训练的投影层进行维度对齐。然后输入多模态变换器块。

- 多模态变换器块:这是架构的核心。其内部采用“联合注意力”机制,将视频、音频、文本的查询(Q)、键(K)、值(V)拼接后进行缩放点积注意力,从而融合跨模态信息。同时,模型使用“全局条件”来调节网络。全局条件向量聚合了扩散时间步、音频时长嵌入、以及视觉和文本特征的平均池化结果。这个条件向量通过自适应层归一化(AdaLN)注入到每个变换器层。

- PAAPI机制:在联合注意力模块内,PAAPI选择性地对具有时序结构的模态(视觉、音频、对齐的转录文本)应用旋转位置编码(RoPE),而对非时序的模态(如全局文本描述)则保持其位置信息不变(各向同性)。这确保了不同模态在相位对齐的情况下共享位置先验,增强了唇音同步等精细对齐能力。

- 音频专用细化:经过多模态块后,特征会通过专门的音频单模态变换器块(类似FLUX设计)进一步细化,专注于音频信号的细节生成。

- 解码与损失:细化后的音频特征通过梅尔解码器重建为音频波形。训练时,模型采用条件流匹配(CFM)损失,学习从噪声到目标音频潜在表示的速度场。

图1 (b) 一个MM-DiT块的内部结构:详细展示了联合注意力、PAAPI(RoPE)、全局条件(通过AdaLN注入)以及卷积MLP(ConvMLP)等组件。可以看到视频(Vp)、转录文本(Cp)和全局文本(Tp)的特征如何通过拼接、加和以及条件调制参与到注意力计算中。

图1 (b) 一个MM-DiT块的内部结构:详细展示了联合注意力、PAAPI(RoPE)、全局条件(通过AdaLN注入)以及卷积MLP(ConvMLP)等组件。可以看到视频(Vp)、转录文本(Cp)和全局文本(Tp)的特征如何通过拼接、加和以及条件调制参与到注意力计算中。

关键设计选择与动机:

- 解冻所有模态并采用掩码输入:动机是避免“文本冻结”范式造成的语义锁定,让所有模态能在统一的潜在空间中灵活交互,更好地处理缺失输入。

- 轻量级歌词-转录编码器:动机是提供一个不依赖外部音素时长预测器的端到端方案,直接将字符/音素序列转换为帧级表示,简化流程并支持多语言。

- PAAPI:动机是解决多模态模型中不同模态位置信息异构性的问题,确保时序对齐只发生在应该对齐的模态之间,提高同步精度。

- 混合使用MM-DiT和音频单模态块:动机是平衡多模态交互的需要和音频信号自身的精细建模需求。

💡 核心创新点

- 首个统一的音频/语音/歌曲多模态生成框架:不同于之前只处理音效、只处理语音或只处理音乐的专门模型,AudioGen-Omni通过统一的架构和训练,实现了从视频或文本生成所有类型的音频内容,提升了任务泛化能力。

- 无监督的帧级歌词-转录编码器:该模块无需预先的音素时长标注,通过统一的多语言分词(VoiceBPE)和卷积网络(ConvNeXt-V2),将文本序列直接映射到与视频/音频帧对齐的密集表示。这简化了多语言语音/歌曲生成的预处理流水线。

- 相位对齐各向异性位置注入(PAAPI):这是实现精细跨模态同步的关键技术。它在模型内部区分对待有时序结构(视频、音频、对齐文本)和无时序结构(描述性文本)的模态,选择性地应用旋转位置编码(RoPE),确保时序模态在注意力计算中拥有对齐的、相位一致的位置先验,从而显著提升了唇音同步(DeSync指标降低)和整体时序连贯性。

🔬 细节详述

- 训练数据:

- 视频-文本-音频数据集:VGGSound, Pandas70M(约4100小时), InterVid(约1900小时)。

- 音频-文本数据集:AudioCaps(约128小时,人工标注), Clotho(约31小时,人工标注), LibriTTS(约585小时), LJ Speech(约24小时), WavCaps(约7600小时,自动标注)。

- 歌曲-歌词数据集:从在线来源收集,总计约1000小时。

- 预处理:使用Qwen-Omni自动生成描述性字幕;使用Whisper进行语音转录;使用FunASR提取帧级歌词及时间戳。

- 损失函数:采用条件流匹配(Conditional Flow Matching, CFM)损失。具体为公式(1):

L_CFM = E_{t,x0,x1,C} ||v_θ(t, C, x_t) - u(x_t | x0, x1)||^2。其中v_θ是模型预测的速度场,u是真实流速度。在推理时,使用Euler积分从噪声t=0.05走到t=1得到音频潜在编码。 - 训练策略:

- 优化器:InverseLR,基础学习率1e-5,权重衰减0.001。

- 学习率调度:包含指数预热和衰减阶段。

- 批次大小:128。

- 训练步数/时长:在8个NVIDIA H800(80GB)集群上训练,总计约3000 GPU小时。

- 权重平均:为提高推理稳定性,使用了模型权重的指数移动平均(EMA)。

- 关键超参数:

- 模型大小:总参数15.5亿(1.55B),其中DiT模型为24层。

- 编码器:文本使用T5-Base(768维);视觉使用ViT-bigG-14-QuickGELU(MetaCLIP),并经Synchformer时序对齐;音频使用基于Kling-Foley的Mel-VAE,将44.1kHz波形编码为43Hz的潜在序列(下采样因子1024)。

- 歌词编码器:嵌入维度768,位置编码最大支持4000个位置。

- 推理细节:

- 采样步数:25步。

- 引导方式:使用Classifier-Free Guidance,引导尺度为4.5。

- 生成时长:模型设计为可生成最长10秒的音频。

- 正则化/稳定技巧:训练中对缺失模态使用掩码和学习到的占位嵌入;长度可变训练通过为起始时间和持续时间学习每秒嵌入来实现;损失计算时使用基于长度的掩码排除填充帧。

📊 实验结果

表1:在VGGSound测试集上的音频生成方法评估

| Method | Params | Distribution matching (FD) | Audio quality (IS) | Semantic align (IB-score) | Temporal align (DeSync) | Time(s) |

|---|---|---|---|---|---|---|

| FDPaSST↓ | FDPANNs↓ | KLPaSST↓ | ↑ | ↓ | ||

| ReWaS [16] | 619M | 141.38 | 17.54 | 2.82 | 8.51 | 14.82 |

| Seeing&Hearing [17] | 415M | 219.01 | 24.58 | 2.30 | 8.58 | 33.99 |

| V-AURA [18] | 695M | 218.50 | 14.80 | 2.07 | 10.08 | 27.64 |

| VATT [19] | – | 131.88 | 10.63 | 1.41 | 11.90 | 25.00 |

| Frieren [20] | 159M | 106.10 | 11.45 | 2.86 | 12.25 | 22.78 |

| FoleyCrafter [21] | 1.22B | 140.09 | 16.24 | 2.23 | 15.68 | 25.68 |

| V2A-Mapper [22] | 229M | 84.57 | 8.40 | 2.56 | 12.47 | 22.58 |

| MMAudio-L-44.1kHz [6] | 1.03B | 60.60 | 4.72 | 1.40 | 17.40 | 33.22 |

| Ours | 1.55B | 58.77 | 6.29 | 1.56 | 21.52 | 29.26 |

关键结论:AudioGen-Omni在分布相似度(FD指标)上显著优于所有基线,在音频保真度(IS)和语义对齐(IB-score)上达到最佳或接近最佳水平,同时保持了较低的DeSync值和很快的生成速度(1.91秒生成8秒音频,论文中表格写为0.450s可能为笔误或不同计算方式,正文强调为1.91秒)。

表2:在LRS3和LRS2测试集上的语音生成方法评估

| Method | Steps | LRS3-TED | LRS2-BBC | ||||||

|---|---|---|---|---|---|---|---|---|---|

| UTMOS↑ | DNSMOS↑ | RMSEf0↓ | WER(%)↓ | UTMOS↑ | DNSMOS↑ | RMSEf0↓ | WER(%)↓ | ||

| Ground Truth | – | 3.545 | 2.582 | – | 2.29 | 3.013 | 2.256 | – | 8.93 |

| 音频驱动说话人嵌入 | |||||||||

| SVTS [23] | – | 1.283 | 1.860 | 56.929 | 84.98 | 1.387 | 1.434 | 53.475 | 83.38 |

| Intelligible [24] | – | 2.702 | 2.395 | 39.377 | 29.60 | 2.331 | 2.000 | 41.233 | 39.53 |

| 视频驱动说话人嵌入 | |||||||||

| LTBS [25] | – | 2.417 | 2.361 | 40.006 | 84.08 | 2.288 | 2.174 | 43.653 | 94.25 |

| DiffV2S [4] | 1000 | 3.058 | 2.558 | 40.893 | 41.07 | 2.945 | 2.363 | 44.414 | 54.86 |

| Faces2Voices [8] | 1000 | 3.993 | 2.759 | 38.928 | 30.37 | 3.881 | 2.552 | 43.702 | 39.05 |

| Ours | 25 | 3.982 | 3.782 | 37.525 | 17.56 | 3.842 | 3.767 | 42.902 | 17.75 |

关键结论:AudioGen-Omni在感知质量(UTMOS, DNSMOS)和可懂度(WER)上全面超越了现有视频到语音(VTS)方法,甚至在LRS3上UTMOS和DNSMOS超过了真实语音(论文解释为生成的语音更干净),WER大幅降低。音高精度(RMSEf0)也得到改善。

表3:在LRS3测试集上的SECS评估结果

| Method | LTBS | DiffV2S | Faces2Voices (1000) | Ours (25) |

|---|---|---|---|---|

| GE2E↑ | 0.609 | 0.621 | 0.650 | 0.691 |

| VoxSim↑ | 0.399 | 0.433 | 0.494 | 0.527 |

关键结论:在说话人相似度评估中,AudioGen-Omni在GE2E和VoxSim两个指标上均取得了最高分,表明其能更好地从视频中捕捉并合成具有目标说话人特征的语音。

图表分析:

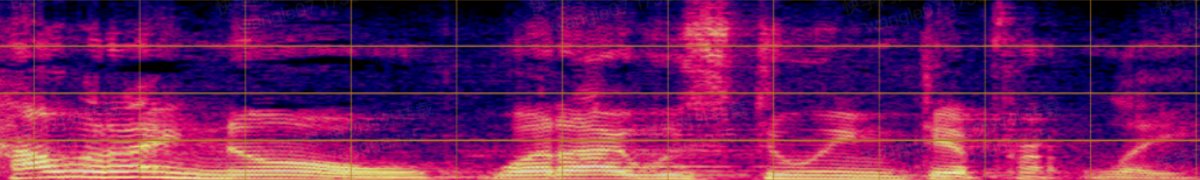

图2 (Mel-spectrogram visualization):该图对比了不同方法生成的语音Mel谱图与真实语音(GT)。可以清晰地看到,AudioGen-Omni(Ours(25))生成的谱图在基频(F0)的动态变化、谐波结构上与GT高度相似,而其他方法(如Face2Voice, DiffV2S)则显得模糊或失真。这直观证明了其在捕捉语音细节和表情韵律方面的优势。

图2 (Mel-spectrogram visualization):该图对比了不同方法生成的语音Mel谱图与真实语音(GT)。可以清晰地看到,AudioGen-Omni(Ours(25))生成的谱图在基频(F0)的动态变化、谐波结构上与GT高度相似,而其他方法(如Face2Voice, DiffV2S)则显得模糊或失真。这直观证明了其在捕捉语音细节和表情韵律方面的优势。

⚖️ 评分理由

- 学术质量(6.0/7):论文的创新性集中体现在统一框架和两个具体技术模块(LT-Encoder, PAAPI)上,思路清晰。实验部分非常充分,不仅在两个不同领域(音频生成、语音合成)的基准上进行了广泛对比,还提供了定性可视化,形成了完整的证据链,证明了方法的有效性和先进性(SOTA)。主要扣分项在于部分技术细节(如PAAPI在注意力中如何具体作用于Q/K/V)描述略显简略,以及由于缺乏开源,部分结论的复现和验证存在障碍。

- 选题价值(1.5/2):该工作聚焦于解决多媒体内容生成中的一个核心且实际的痛点——音频生成的碎片化问题。其“统一”的愿景符合多模态生成模型的发展趋势,具有很强的前沿性和潜在的应用价值,对音频和语音领域的研究者及相关从业者有较高的参考意义。未获得满分是因为对视频输入的强依赖稍微限制了其通用性。

- 开源与复现加成(0.0/1):论文提供了Demo链接,这对于展示模型能力和进行主观评估非常有价值。然而,完全未提及代码仓库、预训练模型权重的公开计划。虽然给出了部分训练细节(如优化器、GPU时间),但缺乏完整的超参数列表、数据处理脚本和模型配置,使得完全复现难度极高。因此,在此项上没有加分。