📄 AudioFuse: Unified Spectral-Temporal Learning Via A Hybrid VIT-1D CNN Architecture for Phonocardiogram Classification

#音频分类 #多模态模型 #混合架构 #医疗音频 #鲁棒性

✅ 7.5/10 | 前25% | #音频分类 | #多模态模型 #混合架构 | #多模态模型 #混合架构

学术质量 7.5/7 | 选题价值 7.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Md. Saiful Bari Siddiqui(BRAC大学计算机科学与工程系)

- 通讯作者:未说明

- 作者列表:Md. Saiful Bari Siddiqui(BRAC大学计算机科学与工程系),Utsab Saha(BRAC大学计算机科学与工程系)

💡 毒舌点评

亮点:论文非常清晰地抓住了“心音分析中频谱与波形信息互补”这一核心矛盾,并设计了一个轻量级双分支架构来同时利用两者,实验也证实了该思路的有效性,尤其是在抵抗域偏移方面表现出色。

短板:所谓的“创新”更多是工程设计上的巧妙组合,后期融合策略(拼接)本身毫无新意,论文也未深入探讨更复杂融合机制(如跨注意力)在此场景下失效的原因,使其理论贡献稍显薄弱。

🔗 开源详情

- 代码:是。论文提供了GitHub代码仓库链接:https://github.com/Saiful185/AudioFuse。

- 模型权重:未提及是否公开预训练模型权重。

- 数据集:使用了公开的PhysioNet 2016和PASCAL数据集,并说明了获取和处理方式(移除泄露数据)。

- Demo:未提及。

- 复现材料:论文提供了主要超参数(学习率、权重衰减、轮数、早停设置),但未提供完整的训练配置、环境依赖文件或检查点。

- 引用的开源项目:论文中未明确列出所依赖的特定开源工具或库(如PyTorch, Hugging Face Transformers等)。

📌 核心摘要

问题:传统心音(PCG)分类方法要么使用2D频谱图(丢失相位和时间精度),要么使用1D波形(难以学习频率关系),二者各有局限。

方法:提出AudioFuse,一个轻量级双分支架构。一个分支是定制的“宽而浅”的Vision Transformer (ViT),用于从2D log-Mel频谱图中提取全局频谱特征;另一个分支是紧凑的1D CNN,用于从原始波形中提取精确的时序特征。两个分支提取的特征向量在最后通过拼接进行后期融合。

创新点:a) 针对PCG信号特性,设计了一个双分支、双模态的表示学习框架;b) 为平衡性能和过拟合风险,对ViT和CNN分支都进行了轻量化设计;c) 通过实验证明了简单拼接融合在该任务上优于更复杂的门控或交叉注意力融合。

实验结果:在PhysioNet 2016数据集上,AudioFuse(拼接融合)从头训练取得了0.8608的ROC-AUC,显著优于单模态基线(频谱图0.8066,波形0.8223)。在具有显著域偏移的PASCAL数据集上,AudioFuse(ROC-AUC 0.7181)的性能远优于频谱图基线(0.4873),展现了强大的泛化能力。具体结果见表1和表2。

模型 #参数 Accuracy F1-Score ROC-AUC MCC 表1:PhysioNet 2016 数据集性能对比 频谱图基线 (ViT) 1.83M 0.7193 ± 0.0071 0.7383 ± 0.0197 0.8066 ± 0.0141 0.4444 ± 0.0211 原始音频基线 (1D-CNN) 675K 0.7376 ± 0.0094 0.7057 ± 0.0260 0.8223 ± 0.0313 0.4884 ± 0.0085 AudioFuse (拼接融合) 2.56M 0.7741 ± 0.0094 0.7664 ± 0.0005 0.8608 ± 0.0127 0.5508 ± 0.0225 表2:PASCAL 数据集泛化性能 ViT - 0.5795 0.3273 0.4873 0.0579 1D-CNN - 0.6818 0.5484 0.6782 0.3152 AudioFuse - 0.7386 0.6667 0.7181 0.4519 实际意义:为生物医学音频(尤其是心音)分析提供了一个高效、可泛化的分类模型,无需大规模预训练,有利于在资源有限的场景下部署。

局限性:a) 模型的优越性在更复杂、更大规模的心音数据集上是否成立有待验证;b) 双分支设计虽然有效,但增加了系统复杂度,推理时需同时处理两种输入;c) 论文未深入分析两个分支所学特征的具体互补性(如可视化)。

🏗️ 模型架构

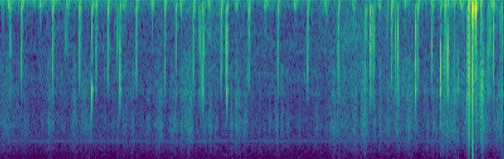

AudioFuse是一个双分支、后期融合的混合架构,整体流程如图1所示。

整体输入输出:

- 输入:5秒长度的原始心音波形(110,250个采样点)。

- 处理:同一输入被转换为两种表示:1) 原始1D波形;2) 224×224的2D log-Mel频谱图。

- 输出:二分类概率(正常/异常)。

主要组件与数据流:

- 频谱图分支 (Spectrogram Branch):

- 输入:log-Mel频谱图。

- 补丁生成与嵌入:通过一个Conv2D层(16×16核,步长与核大小相同)将224×224的图像分割成196个补丁(14×14网格),每个补丁被线性映射为一个192维的嵌入向量。

- Transformer编码器:在补丁嵌入上加上可学习的位置嵌入,然后送入一个由6个Transformer编码块组成的堆栈。每个块包含多头自注意力层(8头)和前馈MLP(2倍扩展率)。使用层归一化(LN)和Dropout进行稳定和正则化。

- 输出:将最后一个Transformer块的输出序列(196个192维向量)进行全局平均池化,得到一个192维的频谱特征向量 fspec。

- 波形分支 (Waveform Branch):

- 输入:1D原始波形。

- 1D-CNN网络:由三个连续的Conv1D块组成。每个块包含:Conv1D层(核大小16,填充以保持序列长度)、ReLU、批归一化(BN)、最大池化(池化核4,步长4)。滤波器数量逐层增加:64 -> 128 -> 256。

- 特征提取:最后一个块的输出经过全局平均池化,然后通过一个带有64个神经元的全连接层,得到一个64维的时序特征向量 fwave。

- 后期融合与分类头 (Late Fusion Head):

- 融合:将 fspec (192维) 和 fwave (64维) 在特征维度上拼接,形成一个256维的融合特征向量 ffused。

- 分类MLP:ffused 先通过一个带有ReLU激活和0.5丢弃率的192个神经元的全连接层,最后通过一个带有sigmoid激活函数的输出层,产生最终的分类概率。

关键设计选择与动机:

- 双分支独立设计:允许每个分支专注于学习其输入模态的最佳特征,避免在早期混合可能导致的特征损失或优化困难。

- “宽而浅”的ViT:较浅的深度(6层)是为了防止在有限的心音数据集上过拟合,同时保持ViT捕捉全局依赖的能力。

- 紧凑的1D-CNN:仅使用三个卷积层和一个全连接层,参数量很少,旨在高效地提取层次化的时间模式。

- 后期拼接融合:选择最简单、最稳定的融合策略,论文实验证明其在此任务上优于更复杂的机制,便于优化和获得高性能。

💡 核心创新点

- 双模态表示学习框架:明确针对心音信号“频谱(音调)与时间(节奏)信息互补”的特性,设计了一个同时从2D频谱图和1D波形中提取特征的统一框架,打破了传统范式对单一表示的依赖。

- 轻量化与抗过拟合设计:在融合模型参数量容易过大的背景下,刻意将ViT设计得“宽而浅”,将CNN设计得紧凑,使得整个模型(2.56M参数)保持轻量级,从而在小规模生物医学数据集上能够有效训练且不易过拟合。

- 实证揭示简单融合的有效性:通过对比实验发现,对于心音分类任务,简单的特征拼接(后期融合)在性能上优于更复杂的门控(FiLM)和跨注意力融合机制。这表明,当两个分支的特征已经足够特异且互补时,无需复杂的交互机制来对齐或选择特征。

🔬 细节详述

- 训练数据:

- 数据集:PhysioNet 2016 Challenge Dataset(域内训练与评估),PASCAL Classifying Heart Sounds Dataset Set B(域外泛化测试)。

- 预处理:为避免数据泄露,从PhysioNet 2016训练集中移除了与验证集重复的患者样本。所有音频被填充或截断为固定5秒长度。进行了数据预加重(未说明具体参数)。

- 数据增强:论文中未提及使用了数据增强技术。

- 损失函数:论文未明确说明损失函数名称,但提到使用了“手动类别权重”来处理数据不平衡,暗示可能使用了加权二元交叉熵损失。

- 训练策略:

- 优化器:AdamW(学习率 3×10⁻⁴,权重衰减 1×10⁻⁴)。

- 训练轮数:最多200个epoch。

- 调度策略:论文中未提及学习率调度器。

- Batch Size:论文中未明确说明。

- 早停:在验证准确率上应用,耐心(patience)为30个epoch。

- 关键超参数:

- 模型总参数量:2.56M。

- ViT分支:补丁大小16×16,嵌入维度192,Transformer块数6,注意力头数8。

- 1D-CNN分支:卷积核大小16,各层滤波器数(64, 128, 256),池化核与步长均为4。

- 融合头MLP:隐藏层单元数192,丢弃率0.5。

- 训练硬件:论文中未说明。

- 推理细节:论文中未说明解码策略等,由于是分类任务,直接取输出概率即可。

- 正则化技巧:使用了Dropout(在Transformer和融合头MLP中)、批归一化(在CNN分支中)。

📊 实验结果

主要基准与数据集:

- 域内评估:PhysioNet 2016数据集(校验后)。

- 域外泛化:PASCAL数据集 Set B。

主要指标与数值:

- PhysioNet 2016 (表1):AudioFuse(拼接融合)在所有指标上均显著优于单模态基线和复杂融合方法,达到了竞争性的SOTA水平。

- PASCAL (表2):AudioFuse的ROC-AUC达到0.7181,相比频谱图基线的崩溃(0.4873)和波形基线的0.6782,证明了其卓越的跨域鲁棒性。

与最强基线的差距:

- 在PhysioNet 2016上,AudioFuse(0.8608 ROC-AUC)比次优的单模态基线(波形0.8223)高出约0.038,比更复杂的Gated FiLM融合(0.8518)高出约0.009。

- 在参数效率上,AudioFuse(2.56M)以远少于传统大模型(如DenseNet169 14.3M)的参数量,达到了有竞争力的性能。

关键消融实验:

- 模态消融:单用频谱图(ViT)或单用波形(1D-CNN)的性能均低于融合模型,证明了双模态互补的必要性。

- 融合策略消融:对比了拼接、Gated FiLM、Cross-Attention三种融合方式。结果显示拼接融合最优,Cross-Attention反而表现不佳(可能由于数据量小导致过拟合)。

- 输入模态消融:Spectrogram-Scalogram融合模型性能很差(ROC-AUC 0.7478),表明两种基于频谱的输入是高度冗余的,进一步支持了选择“频谱图+波形”这对互补表示的正确性。

不同条件下的结果:

- 论文展示了模型在不同数据分布(域内vs.域外)下的表现,这是其最重要的实验之一,有力证明了融合模型在泛化性上的优势。

⚖️ 评分理由

- 学术质量:5.5/7:论文在技术实现上严谨,实验设计全面(基线、消融、跨域测试),数据处理考虑了泄露问题,结果可信。创新性体现在对特定问题的针对性系统设计和有效实证,而非提出全新的理论或算法。

- 选题价值:1.5/2:心音分类是具有明确社会价值的医疗AI应用,本文关注的“从有限数据学习可泛化表示”是实用化的关键瓶颈,选题具有现实意义。

- 开源与复现加成:0.5/1:提供了公开的代码仓库,极大便利了社区验证和后续研究。但未提供预训练模型和详细的配置文件,复现仍有一定门槛。