📄 Asynchrony-Aware Decoupled Multimodal Control for Cued Speech Video Generation

#语音合成 #扩散模型 #流匹配 #音视频 #低资源

✅ 7.5/10 | 前10% | #语音合成 | #扩散模型 | #流匹配 #音视频

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 -0.5 | 置信度 高

👥 作者与机构

- 第一作者:Fengji Ma(香港科技大学(广州))

- 通讯作者:Li Liu(香港科技大学(广州),邮箱:avrillliu@hkust-gz.edu.cn)

- 作者列表:Fengji Ma(香港科技大学(广州))、Xiao-Ping Zhang(清华伯克利深圳学院)、Li Liu(香港科技大学(广州))

💡 毒舌点评

这篇论文的亮点在于将“手语视频生成”这个具体任务分解得非常清晰,并针对其中“控制纠缠”、“动作异步”和“长视频漂移”三个痛点分别设计了技术方案(DCL、SAMP、MS-CWD),体现了扎实的工程思维和问题导向。然而,其短板也显而易见:作为一篇强调生成质量的工作,却未提供任何开源代码或预训练模型,甚至训练数据集的公开性也未明确,这极大削弱了其作为学术贡献的可验证性和后续研究价值;此外,长视频一致性的验证仅在500帧左右,对于实际应用可能需要更长序列的表现未做探讨。

🔗 开源详情

根据论文全文内容:

- 代码:论文中未提及代码链接或开源仓库。

- 模型权重:未提及公开模型权重。

- 数据集:论文提及使用了扩展版MCCS数据集,但未说明该数据集是否公开、如何获取。

- Demo:未提及提供在线演示。

- 复现材料:论文给出了一些实现细节(如基础模型、主要模块、分阶段训练思路、学习率),但缺少关键复现信息,如:完整的超参数配置、具体的数据预处理流程、评估脚本、以及用于推理的MS-CWD的具体参数设置。

- 引用的开源项目:论文在方法中引用了多个开源工具/模型作为组件或基线,包括:Wan2.1 [28](基础模型),Wav2Vec 2.0 [29](语音编码器),uMT5 [30](文本编码器),CLIP [31](图像编码器),DWPose [22](姿态提取)。在对比实验中引用了StableAnimator [33] 和 UniAnimate-DiT [20]。

- 开源计划:论文中未提及任何开源计划。

📌 核心摘要

- 要解决的问题:论文旨在解决从语音和姿态信号生成手语视频(Cued Speech Video)时面临的三个关键挑战:(1) 语音与姿态模态间的控制纠缠,导致嘴唇和手部细节模糊;(2) 手语系统固有的手部动作与语音的自然异步性,严格对齐会导致动作不自然;(3) 长视频生成中缺乏长期时序一致性。

- 方法核心:提出一个名为“解耦课程学习”(Decoupled Curriculum Learning, DCL)的三阶段训练框架。该框架先分别训练语音分支(控制嘴唇)和姿态分支(控制上半身和手势),再进行联合微调。同时,引入了区域感知重建损失(RAR)以增强局部细节,设计了语音异步调制(SAMP)机制来建模手势与语音的自然时间偏移,并提出了多尺度上下文窗口去噪(MS-CWD)推理策略以保证长视频的时序连贯性。

- 与已有方法的创新点:与以往通用的人像动画或说话人头部生成方法不同,本文是首个针对“手语视频生成”这一特定任务进行系统性建模的工作。其创新点包括:(1) 明确的解耦训练策略(DCL)以避免模态干扰;(2) 区域感知的精细化损失(RAR)聚焦于嘴唇和手部这两个关键区域;(3) 首次在生成任务中显式建模语音与手势的异步关系(SAMP);(4) 专为长视频设计的多尺度、加权融合的推理算法(MS-CWD)。

- 主要实验结果:在自建的普通话手语(MCCS)数据集上,本文方法在所有评估指标上均优于StableAnimator (SA) 和 UniAnimate-DiT (UAD) 两个SOTA方法。具体数值见表1。消融实验证明,移除任何一个提出模块(DCL, RAR, SAMP, MS-CWD)都会导致性能下降,其中移除DCL影响最大。图4显示,在500帧长视频中,本文方法的手部关键点置信度(HKC)和语音-嘴唇同步置信度(Sync-C)的衰减率仅为约3%,远低于基线方法(约7%-22%)。

- 实际意义:该技术有望为听障人群生成易于理解的、手语辅助的教学或交流视频,打破沟通壁垒。其提出的技术(如异步建模、长视频生成)也可能迁移至其他需要多模态协调控制的视频生成任务中。

- 主要局限性:论文未提供代码和模型,复现困难;实验仅在普通话手语数据集上进行,未验证其他语言手语的通用性;未分析模型的计算开销和训练成本;长视频测试的最长长度为500帧,对于更长的序列(如分钟级)的稳定性有待进一步验证。

🏗️ 模型架构

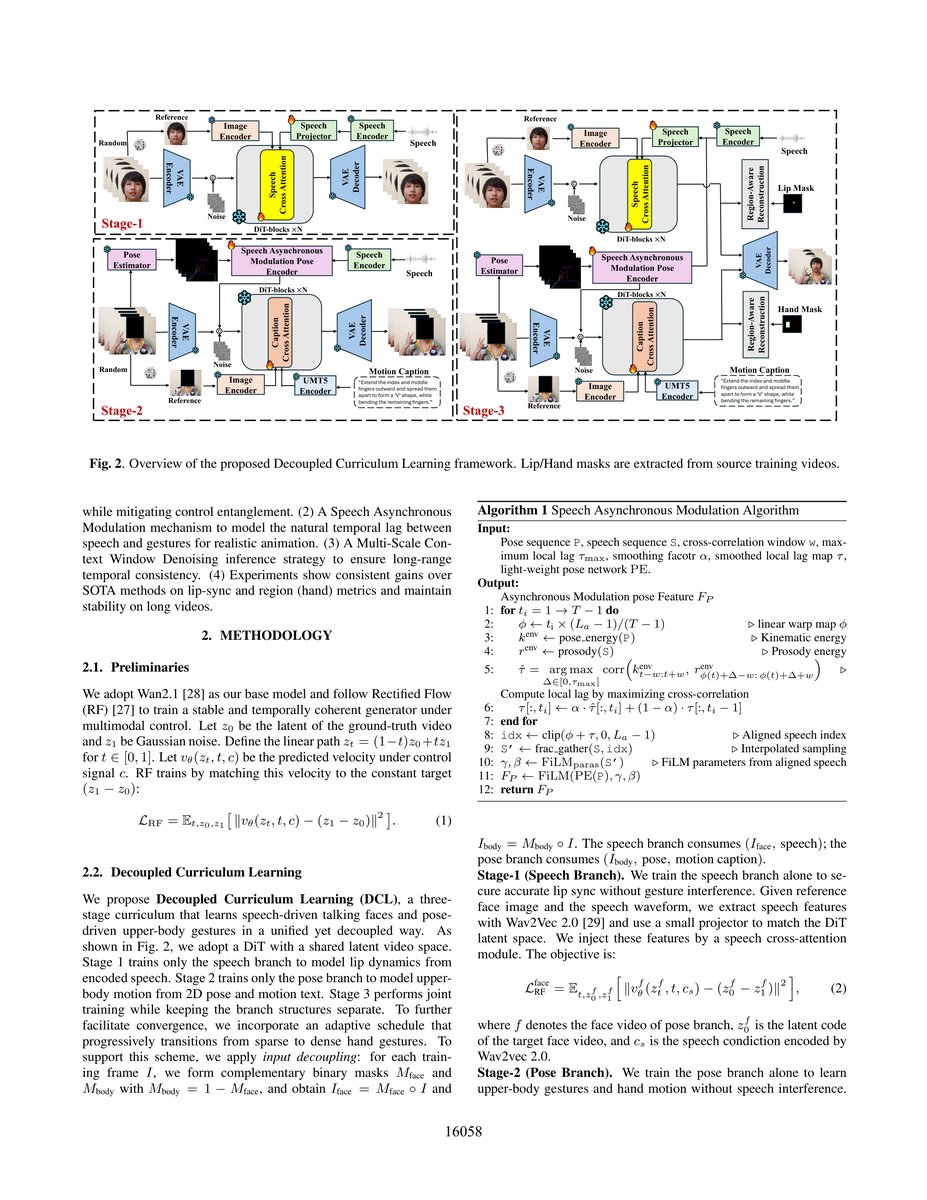

论文的整体架构基于一个扩散Transformer(DiT)骨干网络,并遵循Rectified Flow(RF)目标进行训练。其核心设计是“解耦课程学习”(DCL),分为三个阶段(如图2所示):

Stage-1(语音分支训练):

- 输入:参考人脸图像

Iface和语音波形。 - 处理:语音通过Wav2Vec 2.0编码器提取特征,经一个投影器映射到DiT的潜在空间。这些特征通过“语音交叉注意力”(Speech Cross Attention)注入到DiT块中。

- 目标:仅训练嘴唇区域,使用损失

L_face^RF。输入数据通过人脸掩码Mface从原始图像中提取。

Stage-2(姿态分支训练):

- 输入:参考图像的上半身区域

Ibody、2D姿态序列P和由UMT5编码的动作描述文本Motion Caption。 - 处理:动作描述文本通过UMT5编码器编码。同时,使用CLIP图像编码器提取参考图像的特征。这些文本和图像特征通过“标题交叉注意力”(Caption Cross Attention)融合后注入DiT。此外,姿态序列

P会经过“姿态编码器”(Pose Encoder),该编码器受语音异步调制(SAMP) 机制控制(详见02节)。 - 目标:仅训练上半身和手部区域,使用损失

L_body^RF。输入数据通过身体掩码Mbody提取。

Stage-3(联合微调):

- 架构:语音分支和姿态分支的结构保持不变,进行联合训练。语音特征仅流入语音交叉注意力,动作文本特征仅流入标题交叉注意力。

- 关键创新 - 区域感知重建损失(RAR):在最终的去噪步骤(t=0)引入额外的损失。使用从训练数据中提取的嘴唇掩码

Mlip和手部掩码Mhand,对预测的嘴唇和手部区域进行像素级(在潜在空间)的重建损失(公式5)。权重λ_lip和λ_hand与掩码区域面积成反比,以确保对小区域(嘴唇、手)的关注。总损失为L = L_face^RF + L_body^RF + L_RAR(公式6)。

SAMP机制(算法1):

- 该机制嵌入在姿态编码器中。其核心思想是:计算手势的动能包络和语音的韵律包络,在一个滑动窗口内通过最大化互相关来估计每个手势帧相对于语音的最佳时间偏移(滞后量

τ)。然后,用这个估计的偏移量对语音特征进行重采样和对齐。对齐后的语音特征通过线性层生成FiLM参数(γ, β),用于调制(缩放和平移)来自轻量级卷积姿态编码器的姿态特征FP。

MS-CWD推理策略(算法2):

- 多尺度窗口生成:对于一个长度为L的噪声潜在序列,算法生成多个不同尺度

s(步幅为2的幂次增长)的上下文窗口C。小尺度窗口捕捉局部平滑性,大尺度窗口捕捉全局一致性。 - 加权融合去噪:在每个去噪时间步,对所有窗口内的片段分别进行去噪。然后,使用一个对称的余弦函数作为权重

w[k],对窗口中心帧赋予更高权重,边缘帧赋予较低权重。最后,将所有窗口的预测结果按权重加权平均,得到最终的去噪结果z_{t-1}。这有效减少了滑动窗口边界的伪影。

💡 核心创新点

- 解耦课程学习(DCL)框架:将复杂的多模态控制问题分解为两个相对独立的子问题(语音控唇、姿态控手),并按课程顺序分阶段学习,最后联合微调。这有效解决了模态间的控制纠缠问题,使模型能更专注地学习每个模态的精细特征。

- 区域感知重建损失(RAR):针对手语视频中对嘴唇和手部清晰度要求极高的特点,设计了一种空间聚焦的损失函数。它利用掩码,强制模型在训练后期对这两个小区域进行精细化重建,显著提升了局部细节的清晰度。

- 语音异步调制(SAMP)机制:首次在视频生成任务中明确建模和利用语音与手势之间的自然时间异步性。该机制不依赖额外损失函数,而是通过自适应地学习时间偏移量来调制姿态特征,使生成的手势动作与语音在时间上更自然匹配,而非生硬同步。

- 多尺度上下文窗口去噪(MS-CWD):为解决长视频生成中普遍存在的时序漂移和边界伪影问题,提出了一种先进的推理算法。通过多尺度窗口捕捉不同范围的时间依赖,并利用加权平均进行无缝融合,有效保证了生成视频的长期时序一致性。

🔬 细节详述

- 训练数据:使用了一个新的“扩展版普通话手语(MCCS)视频数据集”,具体规模未说明。该数据集包含详细的姿态标注。使用80%的视频进行训练,20%进行测试。训练视频的骨架姿态序列通过DWPose工具提取。

- 损失函数:

- 主要训练目标为Rectified Flow损失(公式1,2,3),即预测速度与目标速度的MSE。

- 额外引入区域感知重建损失(RAR)(公式4,5),包含嘴唇和手部区域的掩码MSE,权重与区域面积成反比。

- 训练策略:

- 基于Wan2.1-I2V-14B基础模型进行训练。

- 采用LoRA优化以保持高效训练。

- 三阶段训练,每阶段进行10,000次迭代。

- 学习率恒定为5 × 10^{-5}。优化器类型、batch size等未说明。

- 关键超参数:

- 基础模型:Wan2.1-I2V-14B。

- 语音编码器:Wav2Vec 2.0。

- 文本编码器:uMT5。

- 图像编码器:CLIP。

- DiT块的具体层数、隐藏维度等未说明。

- 训练硬件:未说明。

- 推理细节:使用MS-CWD策略进行推理(算法2)。涉及上下文窗口大小

l、重叠量m、最大尺度因子smax等参数,具体值未说明。 - 正则化或稳定训练技巧:使用LoRA进行参数高效微调;采用分阶段课程学习。

📊 实验结果

论文在自建的MCCS测试集上与两种SOTA方法进行了定量对比,并进行了充分的消融实验。主要结果如下表所示:

| 方法 | FVD ↓ | HKC ↑ | HKV ↑ | Sync-D ↓ | Sync-C ↑ |

|---|---|---|---|---|---|

| SA [33] | 1047.32 | 0.813 | 23.46 | 13.766 | 0.934 |

| UAD [20] | 723.26 | 0.864 | 24.71 | 9.854 | 2.259 |

| Ours | 564.32 | 0.907 | 25.28 | 7.201 | 7.409 |

| w/o DCL | 723.25 | 0.885 | 24.78 | 9.330 | 3.291 |

| w/o RAR | 617.86 | 0.877 | 24.89 | 8.075 | 5.179 |

| w/o SAMP | 572.07 | 0.892 | 25.03 | 7.201 | 7.409 |

| w/o MS-CWD | 709.32 | 0.883 | 24.83 | 9.135 | 5.034 |

关键结论:

- 全面领先:本文方法(Ours)在FVD(视频质量)、HKC/HKV(手部清晰度和运动丰富度)、Sync-D/Sync-C(唇音同步)三项共五个指标上均显著优于SA和UAD,达到SOTA水平。

- 消融分析:移除DCL(解耦训练)导致性能大幅回退至与UAD相当,证明其对稳定训练和多模态融合至关重要。移除RAR主要影响手部清晰度(HKC)和唇音同步。移除SAMP主要影响FVD和手部指标,但不影响唇音同步(Sync-C),符合其“主要改善手势自然度”的定位。移除MS-CWD导致FVD和唇音同步显著下降,证实其对长视频一致性的重要作用。

定性结果与长视频分析:

图3 显示了在第81、193、325帧的定性对比。SA方法在后期帧出现了明显的身份退化和姿态失真,而本文方法保持了更好的身份一致性和姿态准确性。

图3 显示了在第81、193、325帧的定性对比。SA方法在后期帧出现了明显的身份退化和姿态失真,而本文方法保持了更好的身份一致性和姿态准确性。

图4(a) 展示了区域对比。相较于UAD,应用RAR后生成的嘴唇轮廓更清晰,手部手指细节更分明,伪影更少。

图4(a) 展示了区域对比。相较于UAD,应用RAR后生成的嘴唇轮廓更清晰,手部手指细节更分明,伪影更少。

图5(论文中标为图4(b)) 和 图6: pdf-image-page4-idx5 展示了长视频一致性分析。随着视频帧数增加,SA和UAD的关键点置信度(HKC)和唇音同步置信度(Sync-C)显著衰减,而本文方法的性能衰减非常轻微,在500帧时衰减率仅约3%,证明��MS-CWD策略的有效性。

图5(论文中标为图4(b)) 和 图6: pdf-image-page4-idx5 展示了长视频一致性分析。随着视频帧数增加,SA和UAD的关键点置信度(HKC)和唇音同步置信度(Sync-C)显著衰减,而本文方法的性能衰减非常轻微,在500帧时衰减率仅约3%,证明��MS-CWD策略的有效性。

⚖️ 评分理由

- 学术质量:6.5/7:论文问题定义精准,技术方案完整且针对性强(DCL, RAR, SAMP, MS-CWD),各部分逻辑衔接紧密。实验设计合理,包含全面的定量对比和消融研究,证据链条完整可信。主要扣分点在于部分技术细节(如超参数、硬件)未完全公开,且未提供可复现的材料。

- 选题价值:1.5/2:手语视频生成是面向特殊人群的重要无障碍技术,应用价值明确。虽然任务小众,但其提出的异步建模、解耦控制等思想对更广泛的可控视频生成领域具有参考价值。

- 开源与复现加成:-0.5/1:这是论文最大的短板。论文未提及任何开源承诺,包括代码、模型权重、训练数据集获取方式、或详细的配置文件。这使得其他研究者几乎无法复现其结果,极大地限制了该工作的可验证性和影响力传播。