📄 AMBISONIC-DML: A Benchmark Dataset for Dynamic Higher-Order Ambisonics Music with Motion-Aligned Stems

#数据集 #信号处理 #空间音频 #基准测试

✅ 7.5/10 | 前25% | #数据集 | #信号处理 | #空间音频 #基准测试

学术质量 6.5/7 | 选题价值 1.8/2 | 复现加成 0.3 | 置信度 高

👥 作者与机构

- 第一作者:Seungryeol Paik(首尔大学 智能与信息学系)

- 通讯作者:Kyogu Lee(首尔大学 人工智能项目、首尔大学 人工智能研究所)

- 作者列表:Seungryeol Paik(首尔大学 智能与信息学系)、Taehyup Kim(Dream Scape Inc.)、Kyogu Lee(首尔大学 智能与信息学系、首尔大学 跨学科人工智能项目、首尔大学 人工智能研究所)

💡 毒舌点评

亮点:该工作精准切入了沉浸式音频研究中一个被忽视但关键的痛点,即缺乏动态、音乐化且高精度的基准数据集,其从艺术装置中提炼科研资源的做法颇具巧思。短板:尽管数据集质量评估详尽,但论文更像是一份详实的“产品说明书”,缺乏对基于此数据集能解决哪些具体研究挑战的深入探讨,且开源信息仅限于数据文件,代码级复现材料缺失。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。仅提到包含“自动化OSC渲染和格式验证脚本”,但未公开。

- 模型权重:未提及(本论文不涉及模型)。

- 数据集:公开。提供Google Drive下载链接和Zenodo归档的元数据与校验和。

- Demo:未提及在线演示。

- 复现材料:提供了归一化后的音频文件、轨迹日志和标注表(annotation.xls)。但完整的数据生成流程代码和环境配置未提供。

- 论文中引用的开源项目:提到了使用

pyLoudnorm工具包计算响度,以及使用AmbiX、MagLS等开源工具进行Ambisonics分析和双耳渲染验证。

📌 核心摘要

- 问题:现有公共空间音频数据集主要聚焦于环境声或静态音乐场景,缺乏同时包含动态声源运动轨迹、高阶Ambisonics编码和干声轨道的音乐数据,无法满足音乐驱动的沉浸式音频处理与生成研究需求。

- 方法核心:论文发布了AMBISONIC-DML数据集,包含120个音乐片段。其核心是通过确定性渲染管线(使用SPAT Revolution软件),将专业录制的干声(包含合成器、打击乐、人声等)与作曲家通过OSC实时设计的三维运动轨迹同步,生成5阶Ambisonics(HOA5,36通道)音频及对应的XYZ轨迹数据。

- 创新性:这是首个公开的、提供动态音乐运动轨迹与干声同步的HOA5数据集。与TAU-NIGENS、STARSS23等环境声数据集及EigenScape等静态音乐数据集相比,它提供了独特的动态、结构化音乐内容。

- 主要实验结果:数据集质量评估包括:客观分析显示HOA5编码正确(36通道DOF),运动轨迹对齐精度达±0.10mm。主观听力测试(25名听众)表明,相比立体声和低阶Ambisonics(HOA1/HOA3),HOA5格式在定位(MOS 4.5±0.3) 和 沉浸感(MOS 4.7±0.2) 上显著更优(p<0.01),而立体声在 清晰度(MOS 4.3±0.3) 和 节奏(MOS 4.6±0.2) 上更好。

- 实际意义:为轨迹感知信号处理、运动驱动的音频分离与生成(如空间混合、轨迹条件音乐合成)等前沿研究提供了必需的基准数据集,推动了从艺术驱动到技术验证的闭环。

- 主要局限性:数据集源自特定沉浸式艺术装置,其音乐风格与运动模式的多样性未被量化评估;作为数据集论文,未提出并验证具体的下游AI任务基线模型。

🏗️ 模型架构

本文并非提出一个新的算法模型,而是介绍一个数据集及其构建流程。因此,其“架构”指数据集的生成与组织流程。

整体流程(数据集生成管线):

- 干声录制:在声学处理过的录音棚中,使用专业设备(Apollo X接口、OC818/TLM 103等麦克风)录制各类乐器与人声的干声(mono/stereo)。所有空间与混响处理被禁用,以获得纯净的原始音源。

- 轨迹设计:作曲家使用基于OSC(Open Sound Control)的实时接口,为每个音轨手工设计三维运动轨迹。坐标系以听众(0,0,0)为中心,X、Y、Z分别代表右、前、上方向,采样率50fps。

- 空间渲染:在SPAT Revolution软件中,干声音频作为输入,轨迹OSC数据流作为控制信号。软件根据每个音轨的特定参数(反映作曲意图)和实时位置信息,将其渲染为36通道的HOA5音频(AmbiX格式:ACN/SN3D归一化)。渲染包括可变的混响、反射和距离效果。

- 数据同步与归档:渲染得到的HOA5音频与原始OSC轨迹日志在时间上精确同步。最终输出包括:原始干声、渲染后的单轨及混音HOA5音频、轨迹CSV日志、以及人工标注的功能角色信息(旋律、节奏等)。

数据组织结构:

- RAW_DATA: 包含原始文件。

- REFINED_DATA: 包含归一化后的干声(-35 LUFS)、HOA5音频、轨迹日志及元数据(annotation.xls)。数据按项目分组(EXPEDITION, DIALOGUE),文件索引跨模态同步。

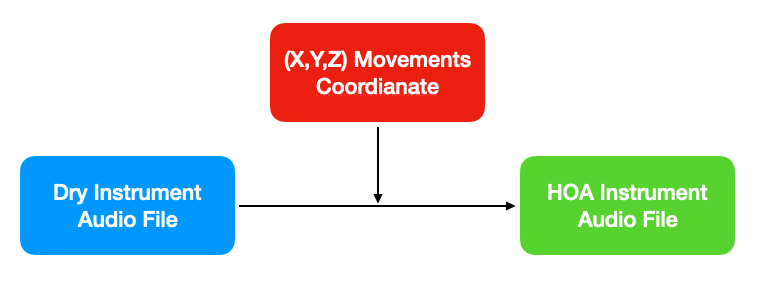

图1(a)展示了数据集中一个条目的组成部分:干声音频、HOA5混音音频和XYZ轨迹。图1(b)展示了使用SPAT Revolution通过基于OSC的运动路径将音轨渲染为36通道AmbiX格式的生成管线。

图1(a)展示了数据集中一个条目的组成部分:干声音频、HOA5混音音频和XYZ轨迹。图1(b)展示了使用SPAT Revolution通过基于OSC的运动路径将音轨渲染为36通道AmbiX格式的生成管线。

关键设计选择:

- 确定性渲染:通过OSC流式传输轨迹,确保声像运动与音乐乐句精确对齐,而非后期算法生成。

- 混合内容来源:数据来自真实的沉浸式艺术装置(《The Expedition》与《Dialogue 02: SYNAPSE》),保证了音乐性与艺术性,但牺牲了像环境声数据集那样的“生态真实性”(如统一的RT60)。

- 双层数据提供:同时提供干声与空间化音频,支持从音源分离到空间音频渲染等多种研究任务。

💡 核心创新点

- 首创性数据模态组合:提供了首个公开的、结合了动态音乐轨迹、5阶Ambisonics高保真音频和同步干声轨道的基准数据集。此前的数据集要么是静态音乐(如管弦乐录音),要么是环境声,要么是低阶Ambisonics。

- 艺术驱动的生成方法:数据集的构建始于沉浸式音乐艺术装置,轨迹是作曲家艺术表达的一部分,而非算法生成的伪影。这保证了运动的音乐意义和复杂性(从突跃到螺旋),为研究“轨迹作为音乐参数”提供了真实素材。

- 高精度与多模态对齐:通过OSC实时渲染管线,实现了亚毫米级(±0.10mm)的音频-轨迹对齐精度,并通过客观分析(从HOA伪强度矢量重建轨迹并与原始日志对比)进行了验证。这对于需要精确时空对应关系的研究(如轨迹条件生成)至关重要。

- 全面的质量验证体系:建立了结合客观音频指标(响度、频谱、空间能量平衡、漫射度)和主观听力测试(定位、沉浸感等多维度)的综合评估框架,不仅证明了数据可用性,也揭示了高阶Ambisonics的感知特性(如沉浸感与清晰度的权衡)。

🔬 细节详述

- 训练数据:未说明。本文是数据集发布,不涉及模型训练。数据集本身包含120个音乐片段,时长从3.2秒到5分钟不等(平均119秒),总时长约4小时。

- 损失函数:未提供。不适用。

- 训练策略:未提供。不适用。

- 关键超参数:

- Ambisonics阶数:N=5,通道数=(5+1)^2=36。

- 轨迹采样率:50 fps。

- 干声归一化标准:-35 LUFS (ITU-R BS.1770)。

- HOA归一化:SN3D (AmbiX标准)。

- 训练硬件:未说明。数据集生成使用Apollo X音频接口。

- 推理细节:未说明。不适用。

- 正则化或稳定训练技巧:未提供。不适用。

- 音频内容统计:乐器构成:合成器43.3%,打击乐9.1%,铜管/木管12.5%,人声10.0%,吉他10.8%,传统乐器5.0%,其他9.3%。功能角色:旋律44%,节奏33%,和弦11%,氛围6%,铺底6%。

📊 实验结果

本文的“实验”旨在验证数据集质量,而非比较算法性能。

主要结果表格:

表1:代表性空间音频数据集对比

| 数据集 | 领域 | Ambisonics阶数 | 运动类型 | 总时长 |

|---|---|---|---|---|

| TAU-NIGENS | 环境声 | FOA | 事件级 | ~10.5 h |

| STARSS23 | 环境声 | FOA | 连续 | ~7.5 h |

| EigenScape | 场景 | HOA4 | 静态 | ~1.0 h |

| Orchestral HOA | 音乐 | HOA3-4 | 静态 | 不定 |

| AMBISONIC-DML | 音乐 | HOA5 | 动态 | ~4.0 h |

结论:AMBISONIC-DML在音乐领域、高阶Ambisonics和动态运动三个维度上均提供了独特的数据。

表2:客观评估结果

| 指标 | 干声 | HOA5 | 运动 |

|---|---|---|---|

| 响度 (LUFS) | -35.0 ± 1.5 | – | – |

| 峰值因子 | 13.7 ± 16.4 | – | – |

| 空间分辨率 (DOF) | – | 36 | – |

| 能量平衡 (X/Y/Z) | – | 0.33/0.34/0.33 | – |

| 漫射度 | – | 0.89 ± 0.09 | – |

| 频谱质心/平坦度 | 2030 / 0.32 | 1865 / 0.35 | – |

| 运动精度 (mm) | – | – | ±0.10 |

结论:干声具有良好的动态范围;HOA5编码正确且能量分布均衡;音频与轨迹对齐精度达到亚毫米级。

表3:主观听力测试结果(平均意见分MOS ± 标准差)

| 格式 | 定位 | 沉浸感 | 清晰度 | 节奏感 |

|---|---|---|---|---|

| HOA1 | 2.8 ± 0.5 | 3.1 ± 0.6 | 4.2 ± 0.4 | 4.5 ± 0.3 |

| HOA3 | 3.7 ± 0.4 | 4.0 ± 0.5 | 4.1 ± 0.5 | 4.0 ± 0.4 |

| HOA5 | 4.5 ± 0.3 | 4.7 ± 0.2 | 4.0 ± 0.4 | 3.6 ± 0.5 |

| 立体声 | 2.9 ± 0.6 | 2.5 ± 0.5 | 4.3 ± 0.3 | 4.6 ± 0.2 |

结论:ANOVA检验显示格式对定位和沉浸感有显著主效应(p<0.01)。HOA5在这两项上得分最高,证明了高阶渲染的空间优势。立体声在清晰度和节奏感上略胜,表明高阶Ambisonics存在一定的瞬态模糊问题。

消融分析:论文提及对HOA5进行下采样生成FOA和HOA3版本,初步分析显示其空间分辨率和漫射度相比HOA5有所降低,但未提供具体对比数字。

其他细分结果:听力测试分析了专家听众(>5年经验)与非专家听众的差异,发现专家对定位退化更敏感,而非专家更注重沉浸感。

⚖️ 评分理由

学术质量:6.0/7

- 创新性:在空间音频数据集领域,填补了“动态+音乐+高阶+干声”的空白,具有明确的领域首创性。但创新集中于数据资源整合与验证,而非提出新的算法或理论。

- 技术正确性:数据集构建流程严谨,参数标准符合业界规范(AmbiX, LUFS),客观评估方法合理,主观测试设计规范(有控制变量、统计检验),技术描述清晰可信。

- 实验充分性:作为数据集论文,其核心“实验”是数据集质量验证,已从多角度(客观指标、主观感知)充分证明了数据的可用性、准确性和感知优势。

- 证据可信度:所有评估结果均有具体数值或统计显著性支持,结论与数据支撑匹配。

选题价值:1.8/2

- 前沿性:精准对接沉浸式媒体(VR/AR/元宇宙)和音频生成AI(如轨迹条件音乐生成)的发展需求,为这两个前沿交叉领域提供了关键基础设施。

- 潜在影响:有望成为后续研究的重要基准,加速轨迹感知音频处理、高阶空间音频编码与生成等方向的发展。

- 实际应用空间:直接服务于沉浸式内容创作、空间音频编解码器开发、以及相关AI模型的训练与评估。

- 读者相关性:对从事空间音频、音频生成、多媒体处理研究的读者具有高参考价值。

开源与复现加成:0.3/1

- 数据集本身已公开,提供了可下载的数据(干声、HOA音频、轨迹)和基本元数据,这是最核心的复现材料。

- 缺失部分:未提供用于生成HOA5文件的OSC渲染脚本、格式验证工具的完整代码,也未提供详细的参数设置日志,这限制了他人精确复现其数据生成管线的可能。