📄 ALMA-Chor: Leveraging Audio-Lyric Alignment with Mamba for Chorus Detection

#音乐信息检索 #多模态模型 #对比学习 #Mamba #端到端

✅ 7.0/10 | 前25% | #音乐信息检索 | #多模态模型 | #对比学习 #Mamba

学术质量 6.5/7 | 选题价值 2.0/2 | 复现加成 -0.5 | 置信度 中

👥 作者与机构

- 第一作者:Ruixi Bao(清华大学电子工程系, TeleAI 研究院)

- 通讯作者:Xiao-Lei Zhang†(TeleAI 研究院), Xuelong Li†(TeleAI 研究院)

- 作者列表:Ruixi Bao(清华大学电子工程系, TeleAI 研究院), Hao Ma(TeleAI 研究院), Shansong Liu†(TeleAI 研究院), Cheng Gong(TeleAI 研究院), Chi Zhang(TeleAI 研究院), Xiao-Lei Zhang†(TeleAI 研究院), Wei-Qiang Zhang(清华大学电子工程系), Xuelong Li†(TeleAI 研究院)

💡 毒舌点评

论文巧妙地将音乐基础模型MERT与前沿的Mamba2架构结合用于长序列副歌检测,并创新性地融入歌词模态信息,在自有数据集上取得了亮眼的性能提升,展现了多模态建模的有效性。然而,其核心验证建立在一个未公开的“内部数据集”上,这使得“超越SOTA”的声明大打折扣,也让其他研究者难以复现和公平评判。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及公开权重。

- 数据集:使用非公开的“内部数据集”,未提及如何获取。

- Demo:未提及在线演示。

- 复现材料:论文描述了训练的两阶段策略、优化器、学习率、早停条件等,但未提供完整的训练脚本、配置文件或预训练模型,细节不足以完全复现。

- 论文中引用的开源项目:使用了MSAF工具(用于复现CNMF和SCluster基线),以及基础模型MERT和歌词编码器架构(遵循SongGen)。

- 开源计划:论文中未提及开源计划。

📌 核心摘要

- 要解决什么问题:现有基于音乐基础模型(如MERT)微调的副歌检测方法存在两个主要问题:一是预训练与微调之间的序列长度不匹配导致长程依赖建模能力不足;二是绝大多数方法只利用音频信息,忽视了歌词中包含的结构与语义线索(如副歌歌词通常重复)。

- 方法核心是什么:本文提出ALMA-Chor,一个端到端多模态框架。其核心是:(1) 使用MERT和独立的歌词编码器分别提取音频和歌词特征;(2) 通过基于段落时间戳的线性插值实现音频与歌词特征序列的粗对齐;(3) 将对齐后的特征拼接,送入具有线性复杂度的Mamba2模型进行长程上下文建模;(4) 使用结合交叉熵损失与成对AUC损失的混合损失函数(权重由MGDA动态平衡)进行训练。

- 与已有方法相比新在哪里:(1) 多模态融合:首次在副歌检测任务中系统性地引入并验证了歌词信息的增益;(2) 高效长序列建模:采用Mamba2替代Transformer,在保证线性复杂度的同时建模全曲上下文,克服了基础模型微调的长度限制;(3) 训练目标优化:设计并自动平衡了多任务损失,同时优化分类精度和排序性能(AUC)。

- 主要实验结果如何:在论文提供的内部测试集上,ALMA-Chor在AUC、F1和准确率上均显著超越了DeepChorus等5个基线模型。具体结果如下表所示:

方法 AUC F1 ACC ALMA-Chor .922 .771 .854 DeepChorus [4] .814 .631 - Highlighter [33] .763 .387 - Chorus-detection [34] .692 .475 - CNMF [35] - .319 .527 Scluster [12] - .531 .373 消融实验证实了歌词编码器、MGDA平衡策略和AUC损失的必要性,并表明Mamba2在相同显存预算下优于Transformer。 - 实际意义是什么:该方法为音乐内容理解提供了一个有效的多模态分析框架,其技术路线(音频-文本对齐、高效序列建模)可推广到音乐摘要、结构分析等其他MIR任务。端到端的预测也便于应用于音乐库浏览、片段生成等实际应用。

- 主要局限性是什么:最大局限在于使用非公开的“内部数据集”,所有结论和性能对比的有效性都局限于该数据集,无法验证其泛化能力。此外,论文未提供代码和模型权重,且对模型具体配置(如Mamba2层数、维度)的说明不够详尽,影响了工作的可复现性和透明度。

🏗️ 模型架构

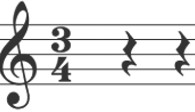

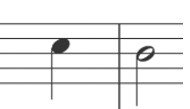

ALMA-Chor是一个端到端的多模态序列标注模型,旨在为一段音乐的每个时间步预测“副歌”或“非副歌”标签。整体架构如图1所示,主要包含以下组件和数据流:

音频编码器:

- 功能:将原始音频波形转换为高维特征序列。

- 内部结构与设计选择:采用预训练的音乐基础模型MERT。为解决MERT预训练窗口短(约5秒)与全曲输入长(240秒+)的不匹配问题,论文采用了分段处理策略:将音频切成5秒片段(1秒重叠),分别输入MERT提取特征(75Hz),然后拼接重叠部分取平均,得到全曲的音频特征序列。

- 动机:匹配预训练长度以有效复用知识,同时降低GPU内存消耗。

歌词编码器:

- 功能:将歌词文本转化为语义特征序列。

- 内部结构:架构和超参数遵循SongGen。它为每个歌词段落生成一个特征序列。

- 与音频编码器的交互:在训练初期,歌词编码器与音频编码器通过对比学习联合训练。对于同一首歌,其音频特征和完整歌词特征构成正样本对��不同歌曲的音频-歌词对构成负样本对。使用基于欧氏距离的InfoNCE变体损失进行优化,使模型学会匹配正确的音频-歌词对。

音频-歌词对齐模块:

- 功能:在特征维度上,将时间步不对齐的音频和歌词特征序列进行匹配。

- 方法:采用线性插值策略,而非动态时间规整(DTW)。它利用歌词的段落级时间戳,在每个段落内部对音频和歌词特征序列进行线性插值,使它们在时间维度上统一。这是一种粗粒度的结构化对齐,旨在提供先验,后续由Mamba2进行自适应精炼。

- 动机:DTW计算成本高且对局部噪声敏感;插值法更高效且能提供结构化的对齐先验。

序列建模模块(Mamba2):

- 功能:对齐并拼接后的联合特征序列进行建模,捕获长程上下文依赖。

- 内部结构:采用Mamba2模型,这是一种具有线性时间与空间复杂度的状态空间模型。图1中(b)部分展示了Mamba2块的结构:输入X通过线性投影生成状态转移矩阵A、输入投影矩阵B和输出投影矩阵C,通过SSM计算后输出Y。

- 数据流:将拼接后的音频-歌词联合特征序列输入Mamba2堆叠层,输出每个时间步的上下文表示。

- 动机:Transformer的二次复杂度使其难以处理长序列;Mamba2的线性复杂度允许在相同显存下处理更长序列或使用更大模型,更适合全曲建模。

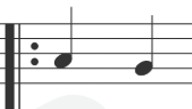

分类头与后处理:

- 分类头:一个轻量级的线性层,将Mamba2输出的每个时间步表示映射为二元概率(副歌/非副歌)。

- 后处理:采用平滑滑动窗口滤波(公式5),利用当前点及未来n个点的预测标签进行多数投票,以抑制异常的标签跳变,增强预测的时序一致性。

- 数据流:Mamba2输出 -> 线性层 -> 原始二值输出 -> 平滑滤波 -> 最终输出。

💡 核心创新点

- 多模态音频-歌词融合框架:针对副歌检测任务,首次系统地提出并验证了联合音频与歌词信息的端到端模型。以往方法主要依赖音频,而歌词(如重复的段落)是副歌的强烈语义信号。该创新通过对比学习预对齐和插值对齐,有效融合了两种模态。

- 基于Mamba2的高效长序列建模:摒弃了对预训练基础模型直接微调或使用Transformer的二次复杂度方案,创新性地采用具有线性复杂度的Mamba2作为主干序列模型。这使得模型能够高效地处理完整的歌曲(240秒以上),直接建模全曲的上下文依赖,解决了现有方法的长程依赖建模瓶颈。

- 动态平衡的多任务混合损失:针对数据中可能存在的类别不平衡以及同时优化分类准确率(交叉熵)和排序性能(AUC)的需求,设计了混合损失函数。其创新点在于使用MGDA算法自动、动态地平衡这两个可能冲突的目标的权重,避免了手动调参,使训练更稳定、优化更全面。

🔬 细节详述

- 训练数据:

- 数据集名称:未提供正式名称,论文中称为“an internal dataset”。

- 来源:内部数据集,包含歌曲MP3、对应歌词及副歌时间戳标注。

- 规模:训练集969首,验证集69首,测试集100首。总规模约1138首。

- 预处理:音频采样率24kHz。训练时输入窗口为240秒。

- 数据增强:未提及。

- 损失函数:

- 名称:混合损失,包含交叉熵损失和成对平方损失(用于AUC最大化)。

- 作用:交叉熵损失优化每个时间步的二元分类准确率;成对平方损失优化模型将正样本(副歌)排在负样本(非副歌)之前的整体排序能力,提升判别力和鲁棒性。

- 权重平衡:使用多重梯度下降算法(MGDA) 在训练过程中动态寻找两个损失函数的帕累托最优解,自动平衡权重。

- 训练策略:

- 学习率:1e-5。

- 优化器:Adam。

- Batch size:未说明。

- 训练步数/轮数:未说明总步数。采用早停策略:每200次迭代评估一次,保存验证集上损失最低的检查点,若连续1000次迭代无改善则停止。

- 调度策略:未提及学习率调度。

- 训练阶段:分为两个阶段:1) 联合训练音频编码器和歌词编码器(参数均解冻);2) 冻结两个编码器,单独训练Mamba2模块(参数解冻)。

- 关键超参数:

- 模型大小:未说明Mamba2的具体层数、隐藏维度等。

- 音频分段:5秒片段,1秒重叠。

- 后处理窗口大小n:未说明具体值。

- 训练硬件:未说明。

- 推理细节:模型接受任意长度音频输入。推理时同样进行分段特征提取、对齐、Mamba2处理和后处理。

- 正则化或稳定训练技巧:使用MGDA进行多目标损失平衡;采用后处理平滑预测结果。

📊 实验结果

主要对比实验(表1):ALMA-Chor在自有测试集上全面超越基线。

| 方法 | AUC | F1 | ACC |

|---|---|---|---|

| ALMA-Chor | .922 | .771 | .854 |

| DeepChorus [4] | .814 | .631 | - |

| Highlighter [33] | .763 | .387 | - |

| Chorus-detection [34] | .692 | .475 | - |

| CNMF [35] | - | .319 | .527 |

| Scluster [12] | - | .531 | .373 |

消融实验(表2):验证了各组件的有效性。

| 方法 | AUC | F1 | ACC |

|---|---|---|---|

| ALMA-Chor (完整) | .922 | .771 | .854 |

| w/o Lyrics Encoder | .885 | .701 | .808 |

| w/o Lyrics Encoder and MGDA | .872 | .686 | .802 |

| w/o Lyrics Encoder, MGDA and AUC Loss | .839 | .661 | .796 |

| Transformer (替换Mamba2) | .815 | .618 | .741 |

关键结论:

- 移除歌词编码器导致性能显著下降(AUC -0.037, F1 -0.07),证明了歌词信息的关键作用。

- 在没有歌词编码器的情况下,移除MGDA和AUC损失会使性能进一步下降,说明多任务损失和动态平衡的价值。

- 在相同显存预算下,将Mamba2替换为Transformer会导致大幅性能下降(AUC -0.107, F1 -0.153),凸显了Mamba2在长序列建模上的优势。

⚖️ 评分理由

- 学术质量:6.5/7:论文提出的多模态框架和采用的Mamba2架构具有明确的创新性和技术合理性。实验设计包含了与先前工作的对比以及充分的消融研究,逻辑链条完整。主要扣分点在于所有验证实验都基于一个非公开的“内部数据集”,这使得其“SOTA”声明的普适性和可复现性受到根本性质疑,降低了整体结论的可信强度。

- 选题价值:2.0/2:副歌检测是音乐理解中的基础且关键任务,具有直接应用价值。将歌词信息融入该任务符合多模态趋势,引入Mamba2应对长序列挑战也紧跟高效架构前沿,选题具有很好的前沿性和实用性。

- 开源与复现加成:-0.5/1:论文未提供代码、模型权重,且核心数据集非公开。虽然描述了训练策略和部分超参数,但缺乏足够的细节(如Mamba2具体配置、后处理窗口大小等)来支持独立复现。这在很大程度上削弱了该工作的可验证性和对社区的贡献度。