📄 AISHELL6-Whisper: A Chinese Mandarin Audio-Visual Whisper Speech Dataset with Speech Recognition Baselines

#语音识别 #迁移学习 #数据集 #音视频

🔥 8.3/10 | 前25% | #语音识别 | #迁移学习 | #数据集 #音视频

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.8 | 置信度 高

👥 作者与机构

- 第一作者:Cancan Li(武汉大学计算机科学学院, 武汉大学人工智能学院)

- 通讯作者:Juan Liu(武汉大学计算机科学学院, 武汉大学人工智能学院)†; Ming Li(苏州城市多模态智能系统重点实验室, 杜克昆山大学数字创新研究中心)†

- 作者列表:Cancan Li(武汉大学计算机科学学院, 武汉大学人工智能学院)、Fei Su(武汉大学计算机科学学院, 武汉大学人工智能学院)、Juan Liu(武汉大学计算机科学学院, 武汉大学人工智能学院)、Hui Bu(北京飞识科技有限公司)、Yulong Wan(OPPO AI中心, 北京)、Hongbin Suo(OPPO AI中心, 北京)、Ming Li(苏州城市多模态智能系统重点实验室, 杜克昆山大学数字创新研究中心)

💡 毒舌点评

这篇论文最大的亮点是“用处很大”——它提供了一个规模空前、包含同步视频的中文耳语音频-视觉数据集,直接解决了该领域数据匮乏的痛点,对推动相关研究价值极高。然而,其提出的“基线模型”本质上是在强大的Whisper-Flamingo框架上做了一些有效的“微调”与“适配”,在模型架构的原创性上并未带来颠覆性突破,更多是工程整合与策略优化。

🔗 开源详情

- 代码:论文明确提供了代码仓库链接:

https://zutm.github.io/AISHELL6-Whisper。 - 模型权重:论文中未明确提及是否公开训练好的模型权重文件,但提供了完整的训练代码和预训练模型依赖,理论上可复现训练过程。

- 数据集:论文明确开源了AISHELL6-Whisper数据集,并提供了下载页面。

- Demo:论文中未提及在线演示。

- 复现材料:论文详细说明了数据处理、模型架构和两阶段训练流程。代码仓库应包含必要的训练脚本和配置。论文还明确指出了所依赖的开源项目:OpenAI Whisper (Large-v3)、AV-HuBERT、Whisper-Flamingo。

- 论文中引用的开源项目:OpenAI Whisper [14], AV-HuBERT [13], Whisper-Flamingo [12], RetinaFace [25]。

📌 核心摘要

- 问题:耳语音识别对于隐私保护、医疗辅助等场景至关重要,但其因缺乏基频、能量低等特点导致识别困难。中文耳语识别发展受限于缺乏大规模专用数据集,尤其是包含音视频信息的数据集。

- 方法核心:作者构建了AISHELL6-Whisper数据集,包含30小时耳语和30小时平行普通语音,其中121位说话人的数据配有同步的正面面部视频。基于此,提出了一个音频-视觉耳语识别基线模型,该模型分两阶段训练:第一阶段在共享的Whisper编码器/解码器上采用并行训练策略,同时处理成对的耳语和普通语音;第二阶段集成视觉特征,并引入一个投影层专门优化耳语特征的表示。

- 与已有方法相比新在哪里:1)数据集规模与模态上远超现有中文耳语数据集(如iWhisper-Mandarin, AVWD)。2)模型方面,创新性地将并行训练策略(强制耳语与普通语音特征对齐)和针对耳语设计的投影层相结合,有效弥合了两种语音模式间的差异。3)在公开的英文耳语基准wTIMIT上验证了方法的跨语言迁移能力。

- 主要实验结果:在自建的AISHELL6-Whisper测试集上,完整模型(包含并行训练+投影层+视频)在耳语上的CER为4.13%,在普通语音上为1.11%。在wTIMIT测试集上,使用在本数据集上预训练的模型进行微调后,在美国口音耳语WER上比原始Whisper Large-V3降低了1.85%,在新加坡口音耳语WER上降低了7.40%,取得了新的最先进(SOTA)结果。关键消融实验证明了并行训练、投影层和视频信息各自带来的性能提升。

| 模型/策略 | Whisper Speech CER | Normal Speech CER |

|---|---|---|

| Whisper (Large-V3) | 18.93% | 3.95% |

| + Finetune | 6.69% | 1.62% |

| + Parallel training | 4.53% | 0.98% |

| + Projection layer | 4.34% | 1.14% |

| + Video | 4.21% | 1.08% |

| + Video (Proposed) | 4.13% | 1.11% |

| 表3:在AISHELL6-Whisper测试集上的性能消融实验。 |

- 实际意义:为中文耳语识别研究提供了宝贵的基准数据集和强基线,推动了该领域发展。所提方法展示了利用平行数据和少量结构改进提升特定语音识别任务的有效性,对低资源或特殊语音模式识别有借鉴意义。

- 主要局限性:论文未探讨耳语识别在真实噪声或低信噪比环境下的性能,而视觉信息在此类场景下可能更为重要。此外,模型依赖于预训练的强力Whisper和AV-HuBERT,对于计算资源有限的团队,完整训练或部署可能具有挑战性。

🏗️ 模型架构

本文提出的基线模型架构如图2所示,其训练分为两个阶段,整体基于Whisper和Whisper-Flamingo框架构建。

- 第一阶段:带投影层的并行训练

- 输入:成对的耳语音频和对应的普通语音音频。

- 处理流程:耳语音频和普通语音音频分别通过同一个Whisper编码器。耳语音频的编码输出\(E_w\)会经过一个额外的投影层模块进行精炼,得到\(E'_w = E_w + \text{ProjectionLayer}(E_w)\)。该投影层是一个轻量级的残差结构(Linear → ReLU → Linear),其设计目的是将耳语嵌入向普通语音的声学特性靠拢。而普通语音的编码输出\(E_n\)则直接进入解码器。

- 解码与损失:精炼后的耳语嵌入\(E'_w\)和普通语音嵌入\(E_n\)共同(但独立地)送入Whisper解码器。解码器分别为两者生成文本预测,并计算各自的交叉熵损失\(L_w\)和\(L_n\)。总损失为\(L = L_w + L_n\)。此并行训练策略旨在利用两种语音间的内在联系,让模型在优化一种语音识别时也能辅助另一种。

- 第二阶段:音视频微调

- 输入:耳语/普通语音的音频及其对应的唇部运动视频(或零向量表示无视频)。

- 处理流程:唇部视频被输入AV-HuBERT编码器提取视觉特征。在Whisper解码器的每个块的起始处,集成一个门控交叉注意力模块(来自Whisper-Flamingo)。该模块将视觉特征与第一阶段得到的音频嵌入进行融合。此阶段通常只训练新增的门控交叉注意力模块,以注入视觉信息。

- 输出:融合了音视频信息后的解码器生成最终的文本转录。

关键设计动机:投影层通过残差连接确保了训练初期模型行为的稳定性(初始化为恒等映射),并专注于学习耳语与普通语音嵌入之间的差异补偿。并行训练则显式地利用了两种语音数据的对应关系,避免了模型在耳语这种单一模态上训练时可能发生的过拟合或特征漂移。

图2:模型架构图。第一阶段(上)展示了并行训练与投影层的作用;第二阶段(下)展示了通过门控交叉注意力集成AV-HuBERT视觉特征的音视频训练过程。

图2:模型架构图。第一阶段(上)展示了并行训练与投影层的作用;第二阶段(下)展示了通过门控交叉注意力集成AV-HuBERT视觉特征的音视频训练过程。

💡 核心创新点

- 构建大规模中文耳语音视频数据集(AISHELL6-Whisper):这是目前规模最大的公开中文耳语音频-视觉数据集(30小时耳语,30小时平行普通语音,包含167名说话人及121人的同步视频)。它填补了中文领域缺乏大规模、高质量、多模态耳语数据的关键空白,为研究提供了坚实基础。

- 提出并行训练策略:将成对的耳语和普通语音同时输入共享编码器/解码器进行训练,利用两种语音模式之间的对应关系,通过联合损失(\(L_w + L_n\))进行优化。相比仅使用耳语数据或简单微调,该策略能更有效地对齐两者的特征空间,显著提升耳语识别性能。

- 设计针对耳语的投影层模块:在Whisper编码器后为耳语路径增加一个轻量级残差投影层。该模块通过学习一个从耳语嵌入到其“补偿表示”的增量,专门优化耳语特征,以更好地适应普通语音识别模型的解码器,有效弥补耳语声学信息的缺失。

- 实现与验证跨语言迁移能力:证明了在大型中文耳语数据集上预训练的模型(包含并行训练和投影层),可以迁移到英文耳语任务(wTIMIT),并取得显著性能提升(SOTA)。这验证了所提数据集和训练策略的通用价值。

🔬 细节详述

- 训练数据:

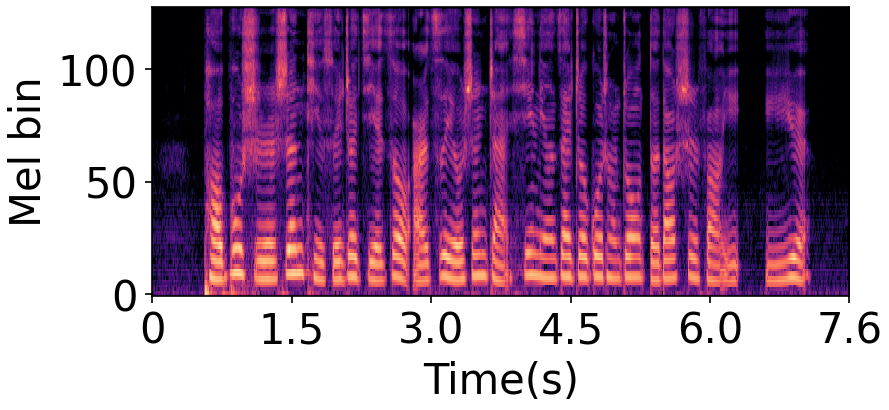

- 数据集:自建的AISHELL6-Whisper。来源:录音棚环境采集。规模:167名说话人,每人朗读约10-20分钟诗歌文本,产生约30小时耳语及对应的30小时普通语音。预处理:使用RetinaFace提取面部关键点,并按固定公式裁剪出96x96的唇部区域视频。通过文本相似度算法(SequenceMatcher)对齐耳语与普通语音片段,形成配对。数据划分:训练、验证、测试集比例约为4:1:1,说话人无重叠。

- 数据增强:未在论文中明确提及使用了何种数据增强技术。

- 损失函数:第一阶段使用标准交叉熵损失(\(L = L_w + L_n\))。第二阶段损失细节未在文中说明。

- 训练策略:

- 学习率:未说明。

- Warmup:未说明。

- Batch size:未说明。

- 优化器:未说明。

- 训练步数/轮数:第一阶段(音频训练)2个epoch,第二阶段(音视频微调)4个epoch。

- 调度策略:未说明。

- 关键超参数:

- 模型大小:基于OpenAI Whisper Large-v3模型(具体参数量未在论文中给出,通常为1.5B左右)和AV-HuBERT编码器。

- 投影层结构:Linear → ReLU → Linear,输入输出维度保持一致。第一层用Kaiming Normal初始化,最后一层零初始化。

- 训练硬件:未说明。

- 推理细节:未说明具体的解码策略(如beam search size)、温度等。

- 正则化或稳定训练技巧:投影层的残差连接和特定初始化策略是一种稳定训练的技巧。

📊 实验结果

主要基准与指标:

- 内部基准:AISHELL6-Whisper测试集,指标为字符错误率(CER)。

- 公开基准:wTIMIT英文耳语数据集,指标为词错误率(WER)和字符错误率(CER)。

- 在AISHELL6-Whisper测试集上的性能(表3) 完整模型(并行训练+投影层+视频)取得了最优性能,耳语CER 4.13%,普通语音CER 1.11%。

| 模型 | Parallel training | Projection layer | Video | Whisper Speech CER | Normal Speech CER |

|---|---|---|---|---|---|

| Whisper (Large-V3) | - | - | - | 18.93% | 3.95% |

| + Finetune | - | - | - | 6.69% | 1.62% |

| + Parallel training | ✓ | - | - | 4.53% | 0.98% |

| + Projection layer | ✓ | ✓ | - | 4.34% | 1.14% |

| + Video | ✓ | - | ✓ | 4.21% | 1.08% |

| + Video (Proposed) | ✓ | ✓ | ✓ | 4.13% | 1.11% |

关键结论:并行训练贡献最大(耳语CER从6.69%降至4.53%);投影层进一步优化耳语(4.53%->4.34%),但轻微影响普通语音;视频信息提供互补线索,尤其与投影层结合时达到最佳平衡。

- 在wTIMIT测试集上的性能(表4) 论文对wTIMIT进行了重划分。使用在AISHELL6-Whisper上预训练的模型进行微调后,结果显著优于直接微调基线。

图3:展示了在wTIMIT测试集上,使用预训练模型(Pre-trained)和提出策略(Proposed Strategies)后,WER和CER的显著下降,尤其是在较难的SG口音上。

图3:展示了在wTIMIT测试集上,使用预训练模型(Pre-trained)和提出策略(Proposed Strategies)后,WER和CER的显著下降,尤其是在较难的SG口音上。

| Model | Pre-trained | Proposed Strategies | WER (%) N-US | WER (%) N-SG | WER (%) W-US | WER (%) W-SG | CER (%) N-US | CER (%) N-SG | CER (%) W-US | CER (%) W-SG |

|---|---|---|---|---|---|---|---|---|---|---|

| [3] | - | - | — | — | — | — | 23.5 | 19.0 | — | — |

| [2] | - | - | 26.8 | 38.6 | 30.7 | 49.2 | — | — | — | — |

| Whisper (Large-V3) | - | - | 5.25 | 8.67 | 8.20 | 19.03 | 1.03 | 2.50 | 2.47 | 8.85 |

| + Finetune | - | - | 5.58 | 7.46 | 7.95 | 15.79 | 0.93 | 1.86 | 2.37 | 7.53 |

| + Finetune* | ✓ | - | 5.78 | 7.64 | 8.42 | 13.84 | 0.95 | 1.81 | 2.15 | 5.76 |

| + Finetune (Proposed)* | ✓ | ✓ | 4.50 | 6.06 | 6.35 | 11.63 | 0.73 | 1.33 | 1.85 | 5.17 |

关键结论:预训练策略和提出策略(并行训练+投影层)结合,将新加坡口音耳语WER从基线的19.03%降至11.63%,降幅达7.40%,证明了方法的迁移有效性。

⚖️ 评分理由

- 学术质量(6.0/7):数据集贡献扎实、价值高。模型技术正确,实验充分对比了各组件贡献,并在自有数据集和公开基准上验证。创新性主要体现在针对特定任务的数据构建和现有模型的巧妙整合与适配上,而非提出全新的基础架构。

- 选题价值(1.5/2):针对耳语识别这一有明确应用需求但数据��缺的挑战性问题,提供了关键的基础设施(数据集)和有效的解决方案,前沿性好,对推动中文及多语言耳语识别研究有重要意义。

- 开源与复现加成(+0.8/1):论文明确开源了数据集和完整的基线代码,提供了依赖项目链接(Whisper, AV-HuBERT, Whisper-Flamingo),极大降低了研究门槛,复现信息非常充分。