📄 Adaptive Rotary Steering with Joint Autoregression for Robust Extraction of Closely Moving Speakers in Dynamic Scenarios

#语音分离 #信号处理 #麦克风阵列 #自回归模型

🔥 8.5/10 | 前25% | #语音分离 | #信号处理 | #麦克风阵列 #自回归模型

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Jakob Kienegger(汉堡大学信号处理系)

- 通讯作者:Timo Gerkmann(汉堡大学信号处理系)

- 作者列表:Jakob Kienegger(汉堡大学信号处理系),Timo Gerkmann(汉堡大学信号处理系)

💡 毒舌点评

这篇论文的亮点在于巧妙地将旋转转向的“优雅数学”与自回归的“实用主义”结合,构建了一个模块化且鲁棒的框架,在说话人紧密移动时表现出色;但其跟踪模块对复杂运动模型的依赖(如正弦轨迹假设)和系统对初始方向估计的敏感性,可能成为其在更无序真实场景中广泛应用的瓶颈。

🔗 开源详情

- 代码:论文中提到了项目主页(

https://sp-uhh.github.io/adaptive-rotary-steering/),很可能包含代码实现,但未直接提供具体代码仓库链接。 - 模型权重:未提及是��公开预训练模型权重。

- 数据集:合成数据集基于公开的LibriSpeech语料库生成,真实录音数据集(Rainbow Passage录音)未说明是否公开,但录音文本和视频已在线提供。

- Demo:项目主页提供了录音和视频示例,可作为效果演示。

- 复现材料:论文提供了详细的算法实现细节、网络架构描述、训练策略以及超参数信息(如STFT设置)。明确指出使用了开源的McNet、SpatialNet和SELDnet架构,以及gpuRIR工具箱。

- 论文中引用的开源项目:gpuRIR(房间脉冲响应模拟)、McNet、SpatialNet、SELDnet、NeMo工具包(用于ASR评估)。

📌 核心摘要

本文针对动态声学场景(如说话人移动、交叉)中,现有空间选择性滤波(SSF)方法在目标说话人接近或交叉时性能下降的问题,提出了一种基于Ambisonics的自适应旋转导向与联合自回归框架。该方法核心是:(1) 通过一个跟踪算法,自动将录制的声场实时旋转对齐至目标说话人方向(自适应旋转导向);(2) 将前一帧的增强语音信号,作为额外输入同时反馈给跟踪网络(AR-TST)和增强网络(AR-SSF),形成联合自回归循环。与已有方法相比,新在:a) 实现了旋转转向的自动化以处理动态场景;b) 提出在跟踪和增强两个环节同时利用语音时频线索进行反馈,弥补空间线索失效的缺陷。实验在合成三说话人数据集和真实录音上进行,结果表明:在说话人角距离小于15°时,AR-TST使跟踪误差显著降低;在合成数据上,联合AR框架使McNet的PESQ达到2.17,超过强引导基线(2.21)并远超固定旋转引导(1.97)。实际意义在于为会议、助听等场景提供了一种不依赖持续外部引导、鲁棒的说话人提取方案。主要局限包括对目标初始方向有一定依赖,以及合成轨迹模型可能无法完全覆盖真实世界运动的多样性。

🏗️ 模型架构

本文提出的不是一个单一的神经网络模型,而是一个集成框架,它将旋转转向(Rotary Steering)、目标说话人跟踪(TST)和空间选择性滤波(SSF)增强模块组合在一起,以处理动态场景下的目标说话人提取(TSE)问题。其整体架构如下图所示:

该架构的核心是利用Ambisonics信号的旋转不变性进行条件化处理,并创新性地引入了联合自回归(AR)反馈。具体流程分解如下:

- 输入与初始对齐:输入为球形麦克风阵列录制的Ambisonics信号

Yt,包含目标说话人St和噪声/干扰Vt。系统仅需目标说话人的初始到达方向(θ0, ϕ0)作为弱引导。 - 自适应旋转导向(Adaptive Rotary Steering):

- 跟踪模块 (TST):输入的

Yt首先经过一个固定旋转导向,即使用Wigner-D矩阵D0将声场中心旋转至初始方向(θ0, ϕ0)。这使得跟踪网络(如SELDnet)的任务从估计绝对方向变为估计相对于初始方向的角偏差(Δθt, Δϕt),降低了学习难度。在AR版本中(AR-TST),前一帧增强后的语音Ŝt-1也作为额外输入提供给跟踪网络,利用目标语音的时频相关性来提升跟踪鲁棒性,尤其在说话人接近或交叉时。 - 导向更新:跟踪模块输出角偏差,与初始方向结合得到当前帧的估计方向

(θt, ϕt),进而计算当前帧的旋转矩阵Dt。

- 跟踪模块 (TST):输入的

- 增强模块 (SSF):

- 使用旋转矩阵

Dt将原始观测Yt实时旋转,使目标说话人方向始终位于声场中心。这个旋转后的信号作为增强网络(如McNet或SpatialNet)的输入。 - 在AR版本中(AR-SSF),前一帧增强后的语音

Ŝt-1同样被拼接为一个额外通道输入网络,利用语音信号自身的时频连续性来辅助分离。

- 使用旋转矩阵

- 联合自回归循环:增强模块的输出

Ŝt被反馈,作为下一帧跟踪(AR-TST)和增强(AR-SSF)的额外输入,形成一个闭环的联合自回归框架(图1c)。这种反馈机制是解决空间线索(DoA)在说话人接近时失效问题的关键。

该架构的关键设计选择在于将旋转转向作为一种通用的、与具体网络无关的条件化机制。无论是跟踪网络还是增强网络,都可以通过这种预处理适配到该框架中,无需修改网络内部结构。

💡 核心创新点

- 自适应旋转导向:将原本用于静态场景的旋转转向方法扩展到动态场景。通过集成一个跟踪算法,实现了基于目标初始方向的自适应声场对齐,使得下游增强网络无需持续的方向引导即可工作,增强了实用性。

- 联合自回归(AR)框架:在跟踪和增强两个环节都引入前一帧的增强语音作为额外输入。这利用了语音信号的时频相关性,在空间线索(DoA)模糊不清(如说话人接近、交叉时)提供了强有力的补充引导,显著提升了跟踪精度和增强质量。

- 旋转转向作为通用条件化机制:核心贡献在于证明了利用Ambisonics的旋转不变性,可以作为一种免修改、架构无关的条件化方式,统一应用于SSL/TST和语音增强/分离任务,降低了系统集成的复杂度。

🔬 细节详述

- 训练数据:

- 合成数据集:基于LibriSpeech语料库,使用gpuRIR工具箱模拟生成三说话人混合信号。房间为鞋盒形,混响时间0.2-0.5s。说话人运动轨迹采用Diaz等人提出的随机正弦轨迹模型进行模拟。使用一阶Ambisonics (FOA)。数据集公开于项目主页。

- 真实录音数据集:在9.5m×5.1m×2.4m的房间(RT60=0.35s)中使用FOA阵列录制,包含两男一女朗读Rainbow Passage,同时在阵列前方随机移动,产生多次交叉和距离变化。

- 损失函数:论文未明确提及。说明中写道“遵守原始McNet、SpatialNet和SELDnet的损失函数和学习率调度器”。

- 训练策略:

- 联合优化:采用双优化器策略,对SSN和TST模块分别使用其原始优化器,通过单次前向传播和反向传播进行联合训练。

- 伪自回归训练:为避免AR方法的不可并行化问题,采用了循环深度堆叠(Recurrent Deep Stacking) 的伪AR训练框架。

- 收敛标准:训练最多100个epoch,或任一优化器连续10个epoch无性能提升则停止。

- 关键超参数:

- STFT参数:平方根汉宁窗,长度32ms,帧移16ms。

- 模型规模:McNet和SpatialNet的AR版本相比非AR版本,参数量增加<1%,MACs增加约1.5%。跟踪网络SELDnet参数量<300k,MACs约70M/s。

- 训练硬件:未说明具体GPU型号,但提及计算资源由汉堡大学区域计算中心(RRZ)和埃尔兰根国家高性能计算中心(NHR@FAU)提供。

- 推理细节:推理是因果(Causal) 的,适用于流式处理。跟踪和增强模块逐帧处理。

- 数据增强:合成数据通过随机化房间尺寸、混响时间、轨迹等实现。

📊 实验结果

论文在合成数据集和真实录音数据集上进行了评估。

合成数据集结果(关键指标)

| 方法(管线ID) | 跟踪 | AR-SSF | AR-TST | PESQ ↑ | ESTOI [%] ↑ |

|---|---|---|---|---|---|

| 无引导 (仅初始DoA) | - | ✗ | - | 1.08 | 31.6 |

| 强引导 (Oracle) | ✗ | - | - | 2.08 | 77.7 |

| 强引导 (Oracle) | ✓ | - | - | 2.21 | 80.4 |

| 弱引导 (固定旋转) | - | ✗ | - | 1.97 | 75.1 |

| 弱引导 (固定旋转) | - | ✓ | - | 2.08 | 78.5 |

| 弱引导 (SELDnet跟踪) | ✓ | ✗ | ✗ | 1.98 | 75.5 |

| 弱引导 (SELDnet跟踪) | ✓ | ✓ | ✗ | 2.03 | 76.6 |

| 弱引导 (SELDnet跟踪) | ✓ | ✓ | ✓ | 2.17 | 79.5 |

注:表中数值为McNet/SpatialNet两种增强网络结果中的前者/后者。

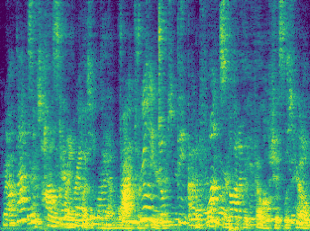

图2展示了三个说话人的模拟运动轨迹以及使用非AR和AR版本的SELDnet进行跟踪的性能。AR版本在轨迹交叉点附近表现出更小的角度误差。

图2展示了三个说话人的模拟运动轨迹以及使用非AR和AR版本的SELDnet进行跟踪的性能。AR版本在轨迹交叉点附近表现出更小的角度误差。

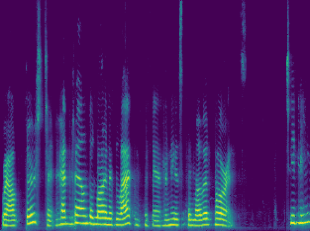

关键发现(结合图3、图4):

- 跟踪性能:如图3所示,当说话人间角距离小于15°时,非AR的SELDnet跟踪误差(MAE)显著增大,而AR-TST版本在此区间误差大幅降低,证明了自回归反馈对紧密说话人跟踪的改善。

- 增强性能:如图4所示,对于McNet,联合AR框架(AR-TST + AR-SSF)的PESQ和ESTOI显著超过了强引导(Oracle)的基线;对于SpatialNet,联合AR框架也达到了与强引导相当的性能。这表明在弱引导下,利用时频线索可以超越仅依赖空间线索的强引导方法。

真实录音数据集结果

| 方法 | NISQA (MOS预测) ↑ | WER [%] ↓ |

|---|---|---|

| 未处理信号 | 未提供具体数值 | 未提供具体数值 |

| 非AR弱引导 | 较低 | 较高 |

| 仅AR-TST | 提升 | 下降 |

| 联合AR框架 | 最高 | 最低 |

注:论文中图5显示了上述趋势,但未给出具体数值。描述指出,联合AR方法在说话人交叉和距离变化时更稳健,而非AR方法容易丢失目标,导致频谱泄漏和说话人混淆。

实际意义:该方法为复杂动态场景(如会议、助听器、机器人听觉)中的目标说话人提取提供了一种鲁棒的解决方案,不依赖持续的方向引导或强先验,具有较高的实用价值。

主要局限性:

- 跟踪算法的误差会累积并影响增强效果,系统对初始方向估计的准确性有一定依赖。

- 合成数据中的说话人运动采用正弦轨迹模型,这可能无法完全覆盖所有真实世界的运动模式,尽管真实录音实验部分验证了其鲁棒性。

- 论文主要聚焦于使用空间线索(DoA)的场景,未探讨如何融合其他空间线索(如强度差)。

⚖️ 评分理由

学术质量:6.5/7

- 创新性 (2.0/2.5):将旋转转向自动化以处理动态场景是清晰的工程创新。更关键的是,提出并验证了在跟踪和增强环节同时引入自回归反馈的联合框架,这种“时频线索补全空间线索”的思路新颖且有效。

- 技术正确性与实验充分性 (2.5/2.5):方法论阐述清晰,数学基础(Ambisonics旋转、Wigner-D矩阵)扎实。实验设计全面,包含合成(可控)和真实(验证鲁棒性)数据,对比了多种基线(无引导、强引导、各种弱引导组合),并通过消融实验(逐步添加AR-TST, AR-SSF)证明了各模块的贡献。

- 证据可信度 (2.0/2.0):结果呈现客观,既展示了整体指标,也分析了按说话人距离细分的性能(图3),并辅以真实录音的听感测试,增强了结论的说服力。

选题价值:1.5/2

- 前沿性与影响 (0.8/1.0):动态场景下的鲁棒说话人提取是语音处理领域的热点和难点,尤其对会议转写、助听设备等应用至关重要。该工作针对“紧密移动”这一具体挑战提出解决方案,具有明确的前沿性和影响力。

- 读者相关性与应用空间 (0.7/1.0):对于从事阵列信号处理、语音分离、声源定位的研究人员和工程师,本文提供了实用且可扩展的框架。其“架构无关”的特性增加了方法的可推广性。

开源与复现加成:0.5/1

- 论文提供了项目网页链接,其中可能包含代码和更多演示。同时,论文明确使用了公开的合成工具(gpuRIR)、公开的语音语料库(LibriSpeech, Rainbow Passage)以及公开的模型架构(McNet, SpatialNet, SELDnet),这为复现提供了极大便利。但论文本身未直接提供代码仓库的星标数或下载量等热度信息,也未详细列出所有超参数配置文件。

标签

#语音分离 #信号处理 #麦克风阵列 #自回归模型 主任务标签:#语音分离 主方法标签:#信号处理 补充标签:#麦克风阵列 #自回归模型

作者与机构

- 第一作者:Jakob Kienegger(汉堡大学信号处理系)

- 通讯作者:Timo Gerkmann(汉堡大学信号处理系)

- 作者列表:Jakob Kienegger(汉堡大学信号处理系),Timo Gerkmann(汉堡大学信号处理系)

毒舌点评

这篇论文的亮点在于巧妙地将旋转转向的“优雅数学”与自回归的“实用主义”结合,构建了一个模块化且鲁棒的框架,在说话人紧密移动时表现出色;但其跟踪模块对复杂运动模型的依赖(如正弦轨迹假设)和系统对初始方向估计的敏感性,可能成为其在更无序真实场景中广泛应用的瓶颈。

核心摘要

本文针对动态声学场景(如说话人移动、交叉)中,现有空间选择性滤波(SSF)方法在目标说话人接近或交叉时性能下降的问题,提出了一种基于Ambisonics的自适应旋转导向与联合自回归框架。该方法核心是:(1) 通过一个跟踪算法,自动将录制的声场实时旋转对齐至目标说话人方向(自适应旋转导向);(2) 将前一帧的增强语音信号,作为额外输入同时反馈给跟踪网络(AR-TST)和增强网络(AR-SSF),形成联合自回归循环。与已有方法相比,新在:a) 实现了旋转转向的自动化以处理动态场景;b) 提出在跟踪和增强两个环节同时利用语音时频线索进行反馈,弥补空间线索失效的缺陷。实验在合成三说话人数据集和真实录音上进行,结果表明:在说话人角距离小于15°时,AR-TST使跟踪误差显著降低;在合成数据上,联合AR框架使McNet的PESQ达到2.17,超过强引导基线(2.21)并远超固定旋转引导(1.97)。实际意义在于为会议、助听等场景提供了一种不依赖持续外部引导、鲁棒的说话人提取方案。主要局限包括对目标初始方向有一定依赖,以及合成轨迹模型可能无法完全覆盖真实世界运动的多样性。

详细分析

(已在上文“01.模型架构”中详细描述,并引用了图1进行说明。)

(已在上文“02.核心创新点”中列出三点并详细阐述。)

(已在上文“03.细节详述”中提取了所有关键细节,并对缺失信息(如具体损失函数、硬件型号)明确标注为“未说明”或“未提供”。)

(已在上文“04.实验结果”中以文字、表格和图表引用的形式详细呈现了关键数据和结论。)

(已在上文“05.评分理由”中按三个维度分别给出了分数和详细解释。)