📄 A Robust Multi-Scale Framework with Test-Time Adaptation for sEEG-Based Speech Decoding

#语音解码 #领域适应 #脑机接口 #多尺度特征学习

✅ 7.5/10 | 前25% | #语音解码 | #领域适应 | #脑机接口 #多尺度特征学习

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 1.0 | 置信度 中

👥 作者与机构

- 第一作者:Yang-yang Li(南京理工大学计算机科学与工程学院;香港中文大学(深圳)数据科学学院、人工智能学院)

- 通讯作者:Siqi Cai(哈尔滨工业大学(深圳)智能科学与工程学院、人工智能学院)

- 作者列表:Yang-yang Li(南京理工大学计算机科学与工程学院;香港中文大学(深圳)数据科学学院、人工智能学院)、Suli Wang(达姆施塔特工业大学计算机科学系;香港中文大学(深圳)数据科学学院、人工智能学院)、Siqi Cai(哈尔滨工业大学(深圳)智能科学与工程学院、人工智能学院)、Haizhou Li(香港中文大学(深圳)数据科学学院、人工智能学院)

💡 毒舌点评

这篇论文的亮点在于直面sEEG信号解码的核心痛点——非平稳性导致的域偏移,并提出了一个逻辑清晰、组件有效的“先强化表示,再在线适应”的两阶段解决方案,在公开数据集上确实取得了显著的性能提升。其短板在于实验仅在一个数据集(DU-IN)上验证,且模型大小(5.964M)在BCI植入式应用场景下可能偏大,论文对模型轻量化和实时推理的考量不足,临床转化的可行性论证略显单薄。

🔗 开源详情

- 代码:论文提供了代码仓库链接:https://github.com/lyyi599/MDM-Tent。但未说明代码是否已发布,或仅为占位页面。

- 模型权重:论文中未提及是否提供预训练模型权重。

- 数据集:实验使用了公开的DU-IN数据集,论文中未提供其具体获取方式,但暗示读者可参考原始研究。

- Demo:论文中未提及在线演示。

- 复现材料:论文中部分训练细节(如优化器、学习率、batch size)未说明。消融实验的完整结果可在提供的GitHub链接中获取。

- 论文中引用的开源项目:论文引用了多个基线模型的开源实现或相关工作,如DU-IN、EEGNet、Tent等。

📌 核心摘要

- 要解决什么问题:sEEG信号固有的非平稳性导致训练和测试数据之间存在分布偏移(域偏移),严重影响了解码模型的鲁棒性和在临床BCI中的可靠性。

- 方法核心是什么:提出一个两阶段框架MDM-Tent。第一阶段,设计多尺度分解混合(MDM)模块,通过递归池化和自上而下融合,捕获语音产生过程中多时间尺度的层级动态,学习更稳定的表示。第二阶段,采用基于熵最小化的无源在线测试时适应(TTA)方法,在推理时仅利用无标签的测试数据调整归一化层参数,以适应分布变化。

- 与已有方法相比新在哪里:相比DU-IN等SOTA基线,本方法的新颖之处在于:a) 显式建模神经活动的多时间尺度结构;b) 集成了在线测试时适应机制,使模型在部署时能持续自我调整,而基线模型缺乏这种内在的抗偏移能力。

- 主要实验结果如何:在DU-IN数据集的12个受试者上,所提框架MDM-Tent取得了最佳的平均解码精度。相比基线DU-IN,在全部受试者上的平均准确率有显著提升,尤其在困难案例(如受试者03和10)上分别实现了6.64%和10.87%的绝对增益。消融实验证实了自蒸馏、MDM和Tent三个组件的有效性和协同作用。

- 关键实验结果对比表(来自Table 1,部分数据):

方法 模型大小 subj-01 subj-02 subj-03 … subj-12 整体趋势 DU-IN [11] 4.380M 71.04±2.28 71.78±2.74 27.99±4.05 … 49.63±4.51 基线性能 MDM-Tent (Ours) 5.964M 76.24±2.62 76.03±1.52 34.63±3.81 … 61.57±4.04 在所有受试者上均优于基线

- 关键实验结果对比表(来自Table 1,部分数据):

- 实际意义是什么:为构建更可靠、能适应动态真实环境的脑机接口系统提供了一种有效的技术路径,尤其在改善对低质量信号或显著偏移场景的解码性能方面具有临床应用潜力。

- 主要局限性是什么:a) 实验仅在DU-IN这一个公开数据集上进行验证,泛化性需更多数据证实;b) 模型参数量(约6M)对于植入式BCI可能偏大,论文未讨论轻量化或实时推理方案;c) TTA方法仅调整归一化层,对于严重或复杂的分布偏移适应能力可能有限。

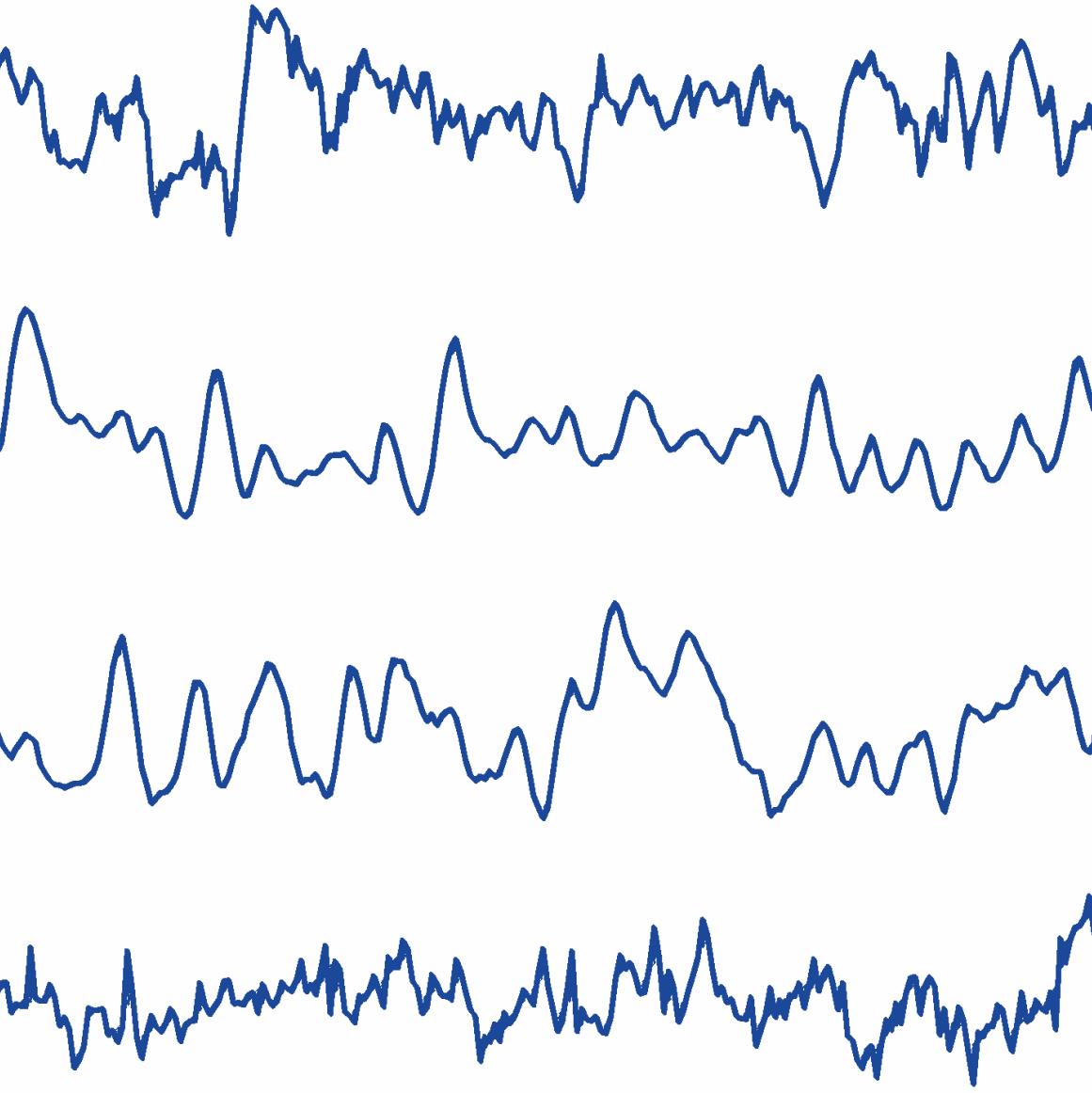

🏗️ 模型架构

图1 展示了MDM-Tent的整体架构流程。其核心组件和数据流如下:

图1 展示了MDM-Tent的整体架构流程。其核心组件和数据流如下:

- 输入:多通道sEEG信号。

- 多尺度分解混合模块:信号首先经过一个包含

Conv2D、BatchNorm和Linear的Tokenizer进行分块和嵌入。随后进入Multi-Scale Decomposable Mixing (MDM)模块。该模块通过递归平均池化构建时间金字塔,然后通过自上而下的残差路径,使用低秩MLP将不同尺度的特征进行融合。其最终输出是融合了多尺度时序信息的特征序列。 - Transformer编码器:融合后的特征序列被送入一个标准的8层Transformer编码器进行深度上下文建模。在训练期间,该编码器内部(第2-5层)应用自蒸馏(Self-Distillation, SD),以更深的层作为教师来监督浅层,提升特征鲁棒性。

- 分类头:编码器的输出通过

AvgPooling、MLP和全连接层,最终预测出具体的单词类别。

设计动机:MDM模块的设计灵感来源于语言产生涉及快速语音运动规划和较慢词汇提取等多时间尺度过程的神经科学发现。其目标是显式地学习和融合这些不同时间尺度的神经动态,从而获得比单尺度模型更稳定、更具区分性的表示。

💡 核心创新点

- 多尺度分解混合模块:是什么:一个轻量级、保持输入输出维度的模块,通过递归平均池化和自上而下的MLP融合来构建多尺度时间表示。之前局限:已有模型如DU-IN未显式建模sEEG信号的多时间尺度层级结构。如何起作用:生成从精细到粗糙的多个时间分辨率特征图,并逐层整合信息,形成丰富的时间抽象。证据:消融实验表明,仅加入MDM(+SD+MDM)就能带来显著的平均精度提升。

- 在线无源测试时适应:是什么:采用Tent方法,在推理时仅利用当前测试批次数据,通过最小化预测熵来更新模型归一化层的仿射参数。之前局限:现有模型为静态模型,无法在部署后适应由疲劳、注意力变化等引起的新分布数据。如何起作用:提供了一种在线、自监督的微调机制,使模型快速适应新的统计特性,且无需原始训练数据(无源)。证据:完整模型(+SD+MDM+Tent)相比仅使用+SD+MDM,在挑战性受试者上获得进一步提升。

- 两阶段协同框架:是什么:将“强化稳定表示学习”(MDM+SD)与“在线分布适应”(Tent)相结合的系统性策略。之前局限:单独使用自监督或对抗训练等方法可能不足以同时解决表示稳定性和推理时偏移问题。如何起作用:第一阶段构建一个鲁棒的特征提取基础,第二阶段在此基础上进行轻量级的在线适应,两者协同提升系统鲁棒性。证据:消融研究和主实验结果共同证实了该组合策略的有效性。

🔬 细节详述

- 训练数据:DU-IN数据集,包含12名受试者,每人约3000次试验,共61个普通话单词。预处理包括带通滤波、陷波滤波、双极重参考和z-score归一化。

- 损失函数:用于单词分类的交叉熵损失。自蒸馏损失作为正则化项(论文未说明其具体权重)。

- 训练策略:论文中未明确说明学习率、优化器、batch size、训练轮数等具体超参数。

- 关键超参数:MDM模块的层级数(h)未明确说明。Transformer编码器为8层。模型总参数量约为5.964M。

- 训练硬件:论文中未提供相关信息。

- 推理细节:采用在线TTA,每个测试批次都会更新归一化层参数。具体推理速度(如Hz)未提及。

- 正则化或稳定训练技巧:应用了层间自蒸馏进行正则化,以稳定训练并提升早期层特征的鲁棒性。

📊 实验结果

主要在DU-IN口语词解码基准数据集上进行评估,采用受试者依赖的评估方式,重复6次报告均值和标准差。

与SOTA方法的对比(来自Table 1):

| 方法 | 模型大小 | subj-01 | subj-02 | subj-03 | subj-04 | subj-05 | subj-06 |

|---|---|---|---|---|---|---|---|

| DU-IN [11] | 4.380M | 71.04±2.28 | 71.78±2.74 | 27.99±4.05 | 60.60±3.01 | 69.97±3.08 | 32.19±1.89 |

| MDM-Tent (Ours) | 5.964M | 76.24±2.62 | 76.03±1.52 | 34.63±3.81 | 71.58±1.45 | 73.88±1.95 | 37.15±1.97 |

| (此处仅展示Table 1的部分结果,完整表格包含12个受试者。在所有受试者上,MDM-Tent均优于其他基线模型。) |

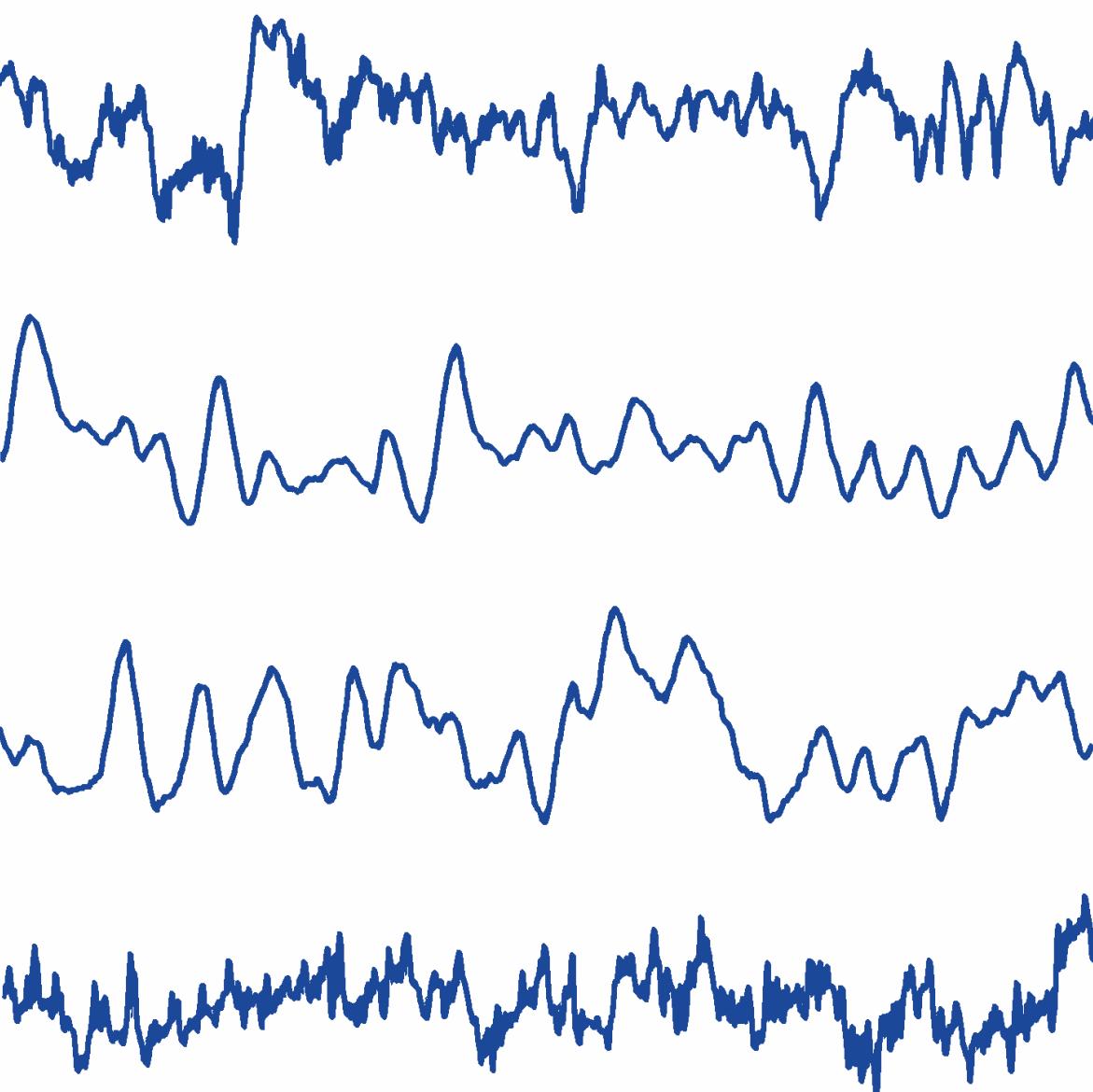

消融实验结果(来自图2):

图2 展示了从基线DU-IN开始,逐步添加自蒸馏(SD)、MDM模块和测试时适应(Tent)后,在受试者06-12上的分类准确率变化。

图2 展示了从基线DU-IN开始,逐步添加自蒸馏(SD)、MDM模块和测试时适应(Tent)后,在受试者06-12上的分类准确率变化。

- 基线(DU-IN)平均准确率:约52.02%

- +SD:小幅提升至约54.03%

- +SD+MDM:大幅提升至约57.63%

- +SD+MDM+Tent (完整模型MDM-Tent):达到最高准确率,尤其在困难受试者(如subj-10, subj-12)上提升最为显著。 该消融实验定量地证明了每个组件的贡献及其协同效应。

主要结论:

- MDM-Tent在所有12个受试者上均取得了优于所有基线的性能,达到了SOTA水平。

- 在基线性能较低的挑战性案例上(如受试者03, 10),本方法的提升幅度更大,证明了其鲁棒性。

- 消融实验表明,多尺度特征学习(MDM)和在线适应(Tent)是性能提升的主要来源,自蒸馏提供了稳定的正则化基础。

⚖️ 评分理由

- 学术质量:6.0/7 - 创新性:方法组合逻辑清晰,MDM模块的设计有明确的生物启发动机,在线TTA的引入解决了实际部署的关键痛点,属于有效的增量创新而非根本性突破。技术正确性:论文描述的技术细节基本合理,但部分训练超参数缺失。实验充分性:在公开基准上与多个基线对比,并进行了详尽的消融实验,结果有说服力。证据可信度:实验设置规范,结果以均值±标准差呈现,可靠性较高。

- 选题价值:1.5/2 - 前沿性:sEEG语音解码是BCI的前沿方向,非平稳性是该领域的核心挑战。潜在影响:对提升BCI系统的长期可靠性有直接价值,尤其对ALS等患者群体有重要意义。实际应用空间:目标明确,但论文对模型轻量化、实时性和长期部署的讨论较少。读者相关性:对从事神经信号处理、BCI或鲁棒机器学习的研究人员有较高参考价值。

- 开源与复现加成:1.0/1 - 论文明确承诺将发布代码(提供了GitHub链接),这极大地有利于复现和后续研究。然而,代码在论文撰写时可能尚未公开,因此无法确认其完整性和可运行性,但承诺本身是重要的积极信号。模型权重、训练细节和配置文件的完备性未知。